Astuce : désactiver l’enregistrement de vos requêtes Siri sur les serveurs d’Apple [MàJ]

Apple martèle à longueur d’années qu’elle fait tout pour préserver la vie privée de ses utilisateurs, mais même Apple fait écouter une partie des requêtes de Siri par des humains pour améliorer son assistant vocal. L’information est apparue après des polémiques similaires concernant Alexa d’Amazon et l’Assistant de Google, mais Siri n’est pas différent finalement, comme on l’a appris en fin de semaine dernière :

Les trois entreprises ont beau expliquer que c’est nécessaire pour améliorer le service, que seule une petite portion des requêtes sont traitées ou encore que l’anonymat des utilisateurs est respectée, c’est un comportement qui peut poser problème. Heureusement, il y a en général des options pour l’éviter, même si elles ne sont pas mises en avant. Pour Siri, il y a bien un moyen, mais il n’est clairement pas pensé pour être mis en place facilement.

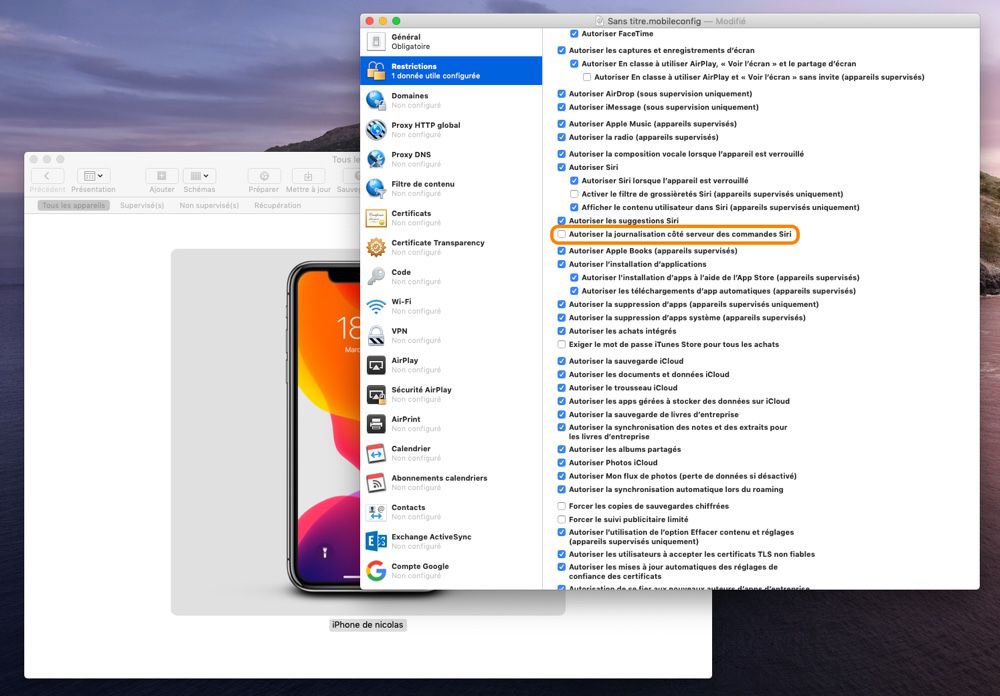

Pour que Siri cesse d’envoyer une partie de vos requêtes sur des serveurs où elles pourraient être sélectionnées pour une analyse humaine, vous devez créer un profil de configuration en utilisant l’app Apple Configurator. Décochez la case « Autoriser la journalisation côté serveur des commandes Siri » dans la section dédiées aux restrictions, puis installez ce profil sur tous vos appareils et vous serez tranquille.

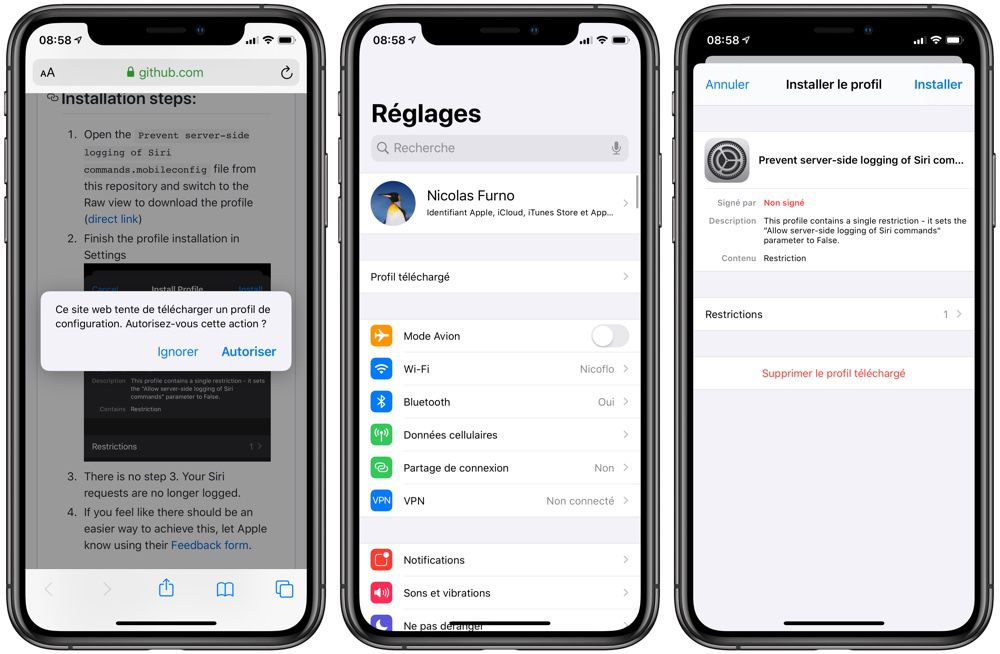

Cette solution nécessite d’avoir un Mac sous la main, ce qui n’est évidemment pas le cas de tous les utilisateurs d’iPhone et iPad. C’est pourquoi un chercheur en sécurité propose sur GitHub un profil prêt à emploi que vous pouvez installer directement sur votre appareil iOS. Comme c’est sur GitHub, le code source est accessible publiquement et permet de vérifier que le profil ne fait qu’une chose, désactiver l’enregistrement sur les serveurs d’Apple des requêtes Siri.

Pour l’installer, vous devez ouvrir le lien direct vers le profil depuis un appareil iOS et autoriser son installation. Ouvrez ensuite l’app Réglages, vous devriez voir une ligne « Profil téléchargé » en haut de l’écran. Dans cette catégorie, vous verrez le profil téléchargé à l’étape précédente et vous pourrez l’installer. Comme il n’est pas signé, iOS demande une confirmation supplémentaire, mais il n’y a pas de risque à l’installer.

Une fois que c’est fait, vous ne noterez aucun changement sur votre appareil, Siri fonctionnera comme avant. Mais ce que vous demandez à l’assistant vocal d’Apple ne sera plus stocké sur des serveurs et potentiellement écouté par des humains. Espérons que le constructeur ajoute une case dans les réglages de Siri pour éviter de passer par un profil, comme le font déjà ses concurrents.

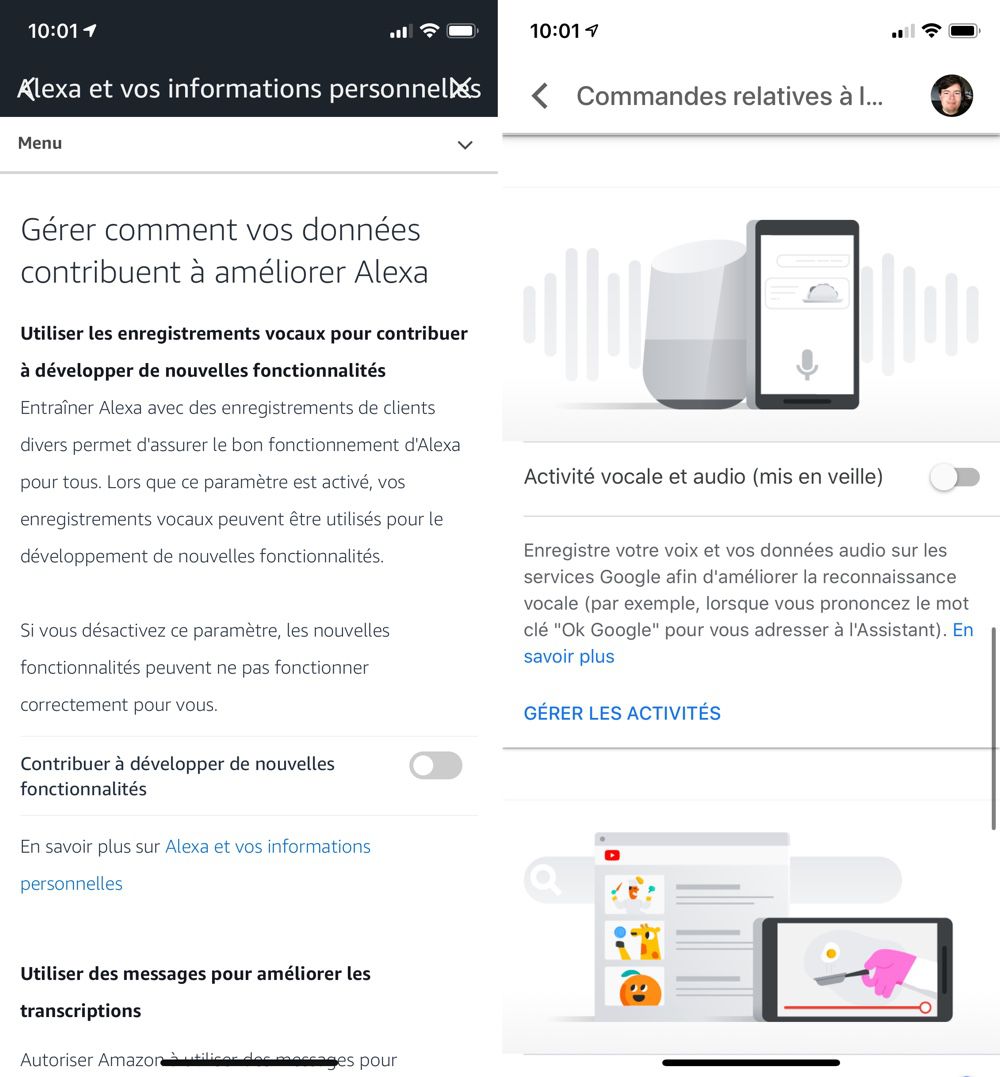

Pour désactiver le traitement humain des commandes vocales Alexa, ouvrez l’app d’Amazon, puis dans les paramètres, ouvrez la section « Alexa et vos informations personnelles » et enfin « Gérer comment vos données contribuent à améliorer Alexa ». Décochez les deux cases pour que vos enregistrements audio ne soient pas traités.

Pour faire la même chose avec Google Assistant, ouvrez l’app et touchez votre avatar en haut à droite de l’écran pour accéder aux paramètres. Sélectionnez ensuite le bouton « Gérez votre compte Google », puis « Infos perso et confidentialité », faites défiler pour trouver « Commandes relatives à l’activité » et décochez le paramètre « Activité vocale et audio ». Dans les deux cas, vous trouverez aussi un historique des commandes enregistrées avec des options pour faire le ménage.

[MàJ 30/07/2019 10h50] : point important à ne pas oublier, l’astuce évoquée ici ne concerne que les appareils iOS et tvOS. L’Apple Watch et le HomePod ont aussi accès à Siri et, sauf erreur de notre part, il n’est pas du tout possible de désactiver le stockage des requêtes sur les serveurs d’Apple.

@depret Lucas

Combien de gens ont comme mot de passe le nom de leurs enfants? Des dates de naissances? Des codes postaux? Leur adresse? Combien de gens utilisent partout le même mot de passe? Combien utilisent « password, 123456, 098765?

Tu es pour le coup bien naïf sur ce qu’ils peuvent en faire, et encore plus sur comment les gens protègent leurs vie privée...

@debione

Tu exagères comme si Apple va prendre des comptes 😂😂😂

Le problème n'est pas Apple... mais les sous-traitants d'Apple ayant accès à toutes ces informations et enregistrements , sous-traitants dont l'article d'hier expliquait qu'ils n'étaient pas très regardants sur le profil des personnes recrutées.

@SyMich

Maintenant c’est des médias attention

@Depret Lucas

C’est vous qui tordez la vérité... Ce n’est PAS Apple qui vous écoute... C’est... euh ben en fait personne ne le sais...

Même pas besoin de le préciser dans l'enregistrement... Siri récupère automatiquement ces informations dans Contacts

Siri a accès à tout, même en l'activant pas. je l'ai pas activé, mais ils te propose des trucs dans les recherches par ex. sur macOS ou iOS.

et il faut pas oublier, qu'en ouvrant les archives (après 100 ans), ils ont découvert que TOUS les marchands anglo-saxons en moyen-orient en 19 siècle étaient sans exemption des agents de la grande Bretagne. ils travaillaient pour eux. et ça se comprend en plus, parce que c'est l'état qui les protège et aide de s'enrichir à l'étranger. leurs intérêts sont communs.

@marenostrum

Ça c’est autre chose mais regarde la vidéo de nowtech

@marenostrum

Et le gouvernement Us a accès à absolument tout ce qui transite sur son territoire, sinon c’est des accusations de haute trahison qui s’applique....

Siri n'est pas anonyme, surtout si l'écoute prend un code et login. En quelques secondes il peut y avoir pas mal de chose à creuser.

Néanmoins Apple le précise dans les CGU je pense, donc à nous de lire dans le détail, plutôt que de faire les choqués.

@Benitochoco

Qui n’est pas le nôtre ;) c’est anonyme dans le sens où on ne sait pas que c’est nous

"... on ne sait pas que c'est nous..." 🤦♂️

L'enregistrement vocal de la requête est accompagné de votre nom, prénom, localité, nom de vos proches, parents, conjoint, enfants... mais "on ne sait pas que c'est vous"!

@SyMich

Au niveau de Siri c’est anonyme c’est écrit, ce que tu me dis là c’est au niveau de l’iPhone, des produits. Pas dû services comme Siri

Je vous ai donné le texte d'Apple expliquant en détail comment sont traitées les requêtes Siri ( page 80 du Guide de sécurité iOS. Il s'agit de Siri!!!) en les associant à vos données personnelles (Nom, prénom, nom de vos proches, listes de lecture musicales, localité... etc) pour permettre à Siri d'être pertinent dans ses réponses.

Arrêtez de prétendre l'inverse!

@SyMich

Comme il fait écrit on a des identifiant aléatoires, Siri connaît notre nom et prénom pour savoir que c’est nous c’est normal mais est-ce que Siri enregistre notre nom pour l’envoyer au serveur ? Je ne pense pas, il envoie un identifiant aléatoire c’est tout.

Il ne s'agit pas de croire ou de ne pas croire... juste de lire ce qu'écrit Apple (et essayer de comprendre):

"Pour mettre en œuvre des fonctionnalités de Siri, certaines données d’utilisateur présentes sur l’appareil sont envoyées au serveur. Cela comprend notamment les données de la bibliothèque musicale (titres des morceaux, artistes et listes de lecture), les noms des listes de rappels, ainsi que les noms et les relations définies dans Contacts.

Lorsqu’une session Siri est lancée, le nom et le prénom de l’utilisateur (provenant de Contacts), ainsi que sa position géographique approximative sont envoyés au serveur.

Si une position plus précise est nécessaire, pour indiquer les salles de cinéma les plus proches par exemple, le serveur demande à l’appareil de lui fournir une position plus précise

L’enregistrement des phrases prononcées par l’utilisateur est envoyé au serveur de reconnaissance vocale d’Apple. Si la tâche n’implique qu’une simple dictée, le texte reconnu est renvoyé à l’appareil. Sinon, Siri analyse le texte et, si nécessaire, le combine avec des informations provenant du profil associé à l’appareil. "

C'est d'ailleurs pour permettre de lier sans erreur une requête Siri au Profil associé à l'appareil (iPhone, AppleWatch...) qu'un identifiant unique est créé pour chaque appareil.

Ce sont donc bien des données personnelles permettant de vous identifier sans erreur qui sont associées aux enregistrements vocaux

Et toutes ces infos sont relayées aux salariés du sous-traitant qui écoute ce qui remonte à Siri pour s'assurer que Siri comprend bien et répond bien.

@SyMich

« Siri est conçu pour emmagasiner un maximum d’informations hors ligne, directement sur votre appareil. Vos recherches et vos demandes ne sont pas associées à votre identité. Ainsi, vos informations personnelles ne sont pas collectées pour être vendues à des publicitaires ou autres entreprises. De plus, le chiffrement de bout en bout garantit que les données synchronisées entre vos appareils ne sont pas accessibles. Pas même par Apple. »

@SyMich

Parce que on va dire qu’ils ont nom et prénom ben c’est quasiment rien comme information personnelle

Ben voyons... 🤦♂️

@SyMich

Et ils ne les vendent pas donc 🤷♂️

Mais on s'en contrefiche qu'ils vendent ou pas nos données personnelles! Ce n'est pas le sujet!

Le sujet c'est que des individus sont payés pour analyser en parallèle de Siri nos requêtes vocales ou ce que Siri prend pour une requête et que ces enregistrements sont livrés à des opérateurs d'un sous-traitant associés à nos noms, prénoms, localité, noms de nos proches, et autres infos très personnelles!

Moi désolée, je n'ai pas envie que si je demande à Siri de programmer un rdv dans mon agenda pour la livraison de ma nouvelle voiture, quelqu'un reçoive l'enregistrement vocal et les informations complémentaires lui apprenant que

Sylvie Dupray, habitant à Paris 17ème, amie de Michèle Pretz, fille de Marcel et Florence Dupray, sœur de Philippe Dupray... va être livrée d'une Mercedes classe À neuve le 2 août à 15h à son domicile

@SyMich

C’est envoyés à Apple ;)

Euh... vous ne comprenez vraiment rien? Où vous souffrez d'un Alzheimer avancé qui vous fait oublier au fur et à mesure ce dont on parlait 5 minutes avant? 😳

Le sujet ce n'est ni Siri ni Apple... mais le fait qu'un certain nombre des enregistrements vocaux sont envoyés par Apple à un sous-traitant (avec toutes les données d'identification associées) pour que des opérateurs, hommes et femmes, analysent ces requêtes pour aider Siri à s'améliorer !

Donc oui c'est envoyé à Apple MAIS ça ne reste pas chez Apple! C'est envoyé chez un tiers dont on ne sait rien et c'est traité par des salariés dont on ne sait rien non plus.

@SyMich

On parle du fait que Siri s’enclenche par accident c’est tout

Vous n comprenez vraiment rien alors... 🤔

Pour vous l'installation du profil, c'est juste pour éviter que Siri enregistre par accident, alors?

Le sujet, depuis hier, ce sont les "oreilles" humaines qui sont derrière Siri susceptibles de récupérer bien des informations sur vous au travers des requêtes qui leur arrivent (qu'elles soient accidentelles ou volontaires!).

c'est pour se protéger de ce traitement manuel par des opérateurs que ce profil a été créé en bloquant le stockage des requêtes sur les serveurs d'Apple (ce qui empêche Apple de les réexpédier vers leur sous-traitant)

@SyMich

Relit l’article, je ne peux rien pour toi. C’est normal que c’est analyser mais le truc chiant c’est que Siri se déclenche par accident.

Je préfère vous laisser dans vos certitudes, je risquerais de devenir mal polie...

Pas une seule fois dans l'article d'aujourd'hui on ne met l'accent sur le déclenchement accidentel de Siri. Le sujet c'est le traitement par des opérateurs humains d'une partie des requêtes de Siri!!!

@Depret Lucas

“Aristote a dit : « L’homme est un animal qui désire le savoir. » C’est faux. L’homme est un animal qui désire la croyance, qui désire la certitude d’une croyance, d’où l’emprise des religions, des idéologies politiques.”

— Cornelius Castoriadis

“Comme il n’est pas signé, iOS demande une confirmation supplémentaire, mais il n’y a pas de risque à l’installer.”

Je ne miserais bcp sur cette affirmation..

Autrement, plus simple peut etre serait de desactiver “Dis Siri” ds les reglages ?

@pierrefeuilleciseaux

À partir du moment où le code est open-source et que l'on voit que le profil ne fait rien d'autre que désactiver l'enregistrement des requêtes Siri, je ne vois vraiment pas le problème… 🤔

Non pour Dis Siri, parce que toutes les requêtes peuvent être analysées.

@nicolasf

Au tps pr moi, je faisais surtout reference aux enregistrements non souhaités, qd Siri s’active par erreur.

Pour ma part, la confidentialité des donnees : un grand oui, c’est mm necessaire et devrait être obligatoire.

Qu’Apple ecoute (ac mn consentement du coup si c’est inscrit ds les conditions générales) mes requetes Siri pr connaitre la meteo ou bien de lancer un compte à rebours, honnêtement, je m’en fiche un peu.

Qu’ils ecoutent par contre sans mon consentement, clairement non.

Mais pour le HomePod et l'Apple watch ça ne marche pas c'est bien cela ?

@Malvik2

Bien vu, Apple Configurator ne gère que les iPhone, iPad et Apple TV. Je vais le préciser dans la news.

C’est absurde de devoir passer par des moyens détournés, ça devrait être un bouton bien gros, dodu et lumineux.

Merci pour le partage ! Vu que chez moi Siri s’active plus souvent par erreur que parce que je le souhaite (je ne l’utilise que très rarement), je vais désactiver ça.

Bonjour, j'ai fait la manip puis une mise à jour d'IOS et j'ai refait la manip par précaution et je pense qu'en cas de mise à jour il faut refaire la mani, mais je n'ai pas les moyens technique de le vérifier.

Have a good day.

C’est nul il faut avoir un mac alors que j’ai un iPhone et une Apple Watch !

Vraiment déçu...😞

Salut Darlito, avec ton Iphone il te suffit de lire l'article et vers la fin il y a un lien qui te permet d'aller chercher le profil que tu retrouveras dans réglages pour l'installer. Pas besoin du mac, je l'ai fait sur Ipad et Iphone.

Mais comme il a une AppleWatch (sur laquelle on ne peut installer de profil) et que la Siri de l'AppleWtatch se déclenche à tord bien plus souvent que sur l'iPhone, ça ne changera pas grand chose pour lui

on peut vraiment installer ce profil sans risque?

@lome_bbrr

D’après l’auteur de l’article, oui. Je l’ai installé sur mon iPad et mon iPhone.

Sauf que si Siri peut s’activer par erreur pour envoyer nos fameuses donnés, vous n’avez qu’à désactiver Détecter « Dis Siri » !

On en revient toujours au fait que les utilisateurs dl'AppleWatch et encore plus de HomePod, pour ceux qui en ont, ne peuvent se "protéger".

L'AppleWatch n'a pas besoin de "dis Siri" pour activer Siri

Le HomePod ne pouvant être commandé que grâce à Siri, la commande "Dis Siri" n'est pas desactivable (du moins à la connaissance)

@SyMich

Ouais, se « protéger » est un grand mot quand même... Sinon pour l’AppleWatch, il faut la porter à la bouche.

Éviter que des individus écoutent ce que je dis, pour moi ça relève d'une action de protection de ma vie privée.

@SyMich

Si, il y a un switch dans l’app Home sur les réglages du HomePod qui permet de désactiver Dis Siri/Hey Siri, pour utiliser le HomePod après ça il faut soit le toucher pour activer Siri ou sinon utiliser AirPlay pour la musique depuis macOS ou iOS

Ah oui. Merci de me rafraîchir la mémoire. N'ayant eu un HomePod que pendant peu de temps, je ne m'en rappelais plus. 👍

@SyMich

De rien !! 👍🏻

Donc ce "patch" permet que:

- Si Siri se lance involontairement

- Que je dise à ce moment une chose compromettante

- Que je dise aussi mon Nom ou quelque chose qui permet de m’identifier

- Que par malchance, ce message est écouté par un humain

- Que cet humain n'a pas une conscience professionnelle (en simplement "oubliant" ce message)

Donc dans ce cas, il faudrait que je mette ce patch.

Je crois que je vais oublier ce patch et continuer à rester Zen.

Vos nom et prénom (issus de Contacts) ainsi que votre position géographique sont (entre autres infos personnelles) automatiquement associés à l'enregistrement vocal pour permettre à Siri de répondre de façon plus pertinente.

Les salariés du sous-traitant, chargés de vérifier comment Siri traite les requêtes, ont également accès à ces information liées à l'enregistrement (pour leur permettre de juger le travail opéré par Siri et corriger si nécessaire)

@pao2

« Siri est conçu pour emmagasiner un maximum d’informations hors ligne, directement sur votre appareil. Vos recherches et vos demandes ne sont pas associées à votre identité. Ainsi, vos informations personnelles ne sont pas collectées pour être vendues à des publicitaires ou autres entreprises. De plus, le chiffrement de bout en bout garantit que les données synchronisées entre vos appareils ne sont pas accessibles. Pas même par Apple. »

Pages