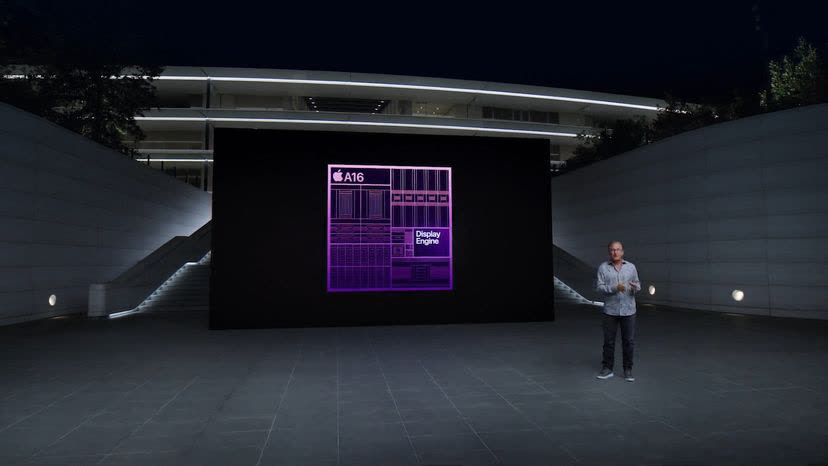

Le système graphique des iPhone 14 Pro et Pro Max aurait pu être beaucoup plus performant, mais Apple a dû se rabattre sur le GPU de l'A16, selon The Information. La puce graphique intégrée dans le system-on-chip (SoC) devait en effet proposer le support du ray-tracing, une technologie qui améliore le rendu des effets lumineux dans les jeux. De quoi en faire un « saut générationnel », espérait-on chez Apple.

Mais voilà, les prototypes ont montré que ce nouveau GPU tirait trop sur la batterie et avait un impact sur la chauffe du smartphone. Le hic, c'est qu'Apple se serait rendu compte du problème assez tard dans le processus du développement de l'A16, ce qui a poussé le constructeur à recycler le circuit graphique de l'A15. Il s'agit de la version à 5 cœurs déjà présente dans l'iPhone 13 Pro, possiblement bonifiée à la marge.

Si le GPU de l'iPhone 14 Pro se montre plus performant que celui de l'iPhone 13 Pro, les résultats ne sont pas pour autant faramineux comme on a pu le mesurer dans nos tests. Ce sera peut-être pour l'A17 l'année prochaine ? À moins que les difficultés recensées par The Information au sein du groupe mené par Johny Srouji ne soient encore plus profondes.

Du rififi chez Srouji

L'erreur du GPU de l'A16 serait en effet sans précédent dans l'histoire d'Apple, qui a jusqu'à présent fait un sans faute dans le domaine des puces mobiles. Les sources du site ont constaté une fuite des cerveaux ces dernières années.

L'exemple de Gerard Williams III est fameux : après son départ d'Apple, ce spécialiste des CPU a fondé Nuvia en 2019 pour développer des puces pour serveurs. La start-up a rapidement été achetée par Qualcomm, et elle planche désormais sur un concurrent pour la M1 d'Apple. Son remplaçant au sein d'Apple, Mike Filippo, ne s'est pas entendu avec les ingénieurs de l'entreprise et est parti chez Microsoft.

Pour limiter les départs, le constructeur aurait organisé des réunions avec ses ingénieurs pour prévenir des risques liés aux start-ups, qui sont peu nombreuses à réussir. Un message suffisant pour contrecarrer les envies d'aventure des forts en thème des CPU ? L'avance prise par Apple dans le domaine des puces mobiles pourrait bien en souffrir, même si elle reste confortable aujourd'hui encore.

Le CPU du Snapdragon 8 Gen 2 ne devrait pas faire mieux que celui de l’Apple A16