C’était une rumeur, mais Apple n’en a pas parlé pendant son keynote de mardi et on pensait que la fonction avait tout simplement disparu. Il n’en est rien finalement et comme pressenti, les iPhone 11 bénéficieront d’une fonction de recadrage qui exploite les données de l’ultra grand-angle, en plus de l’appareil photo principal.

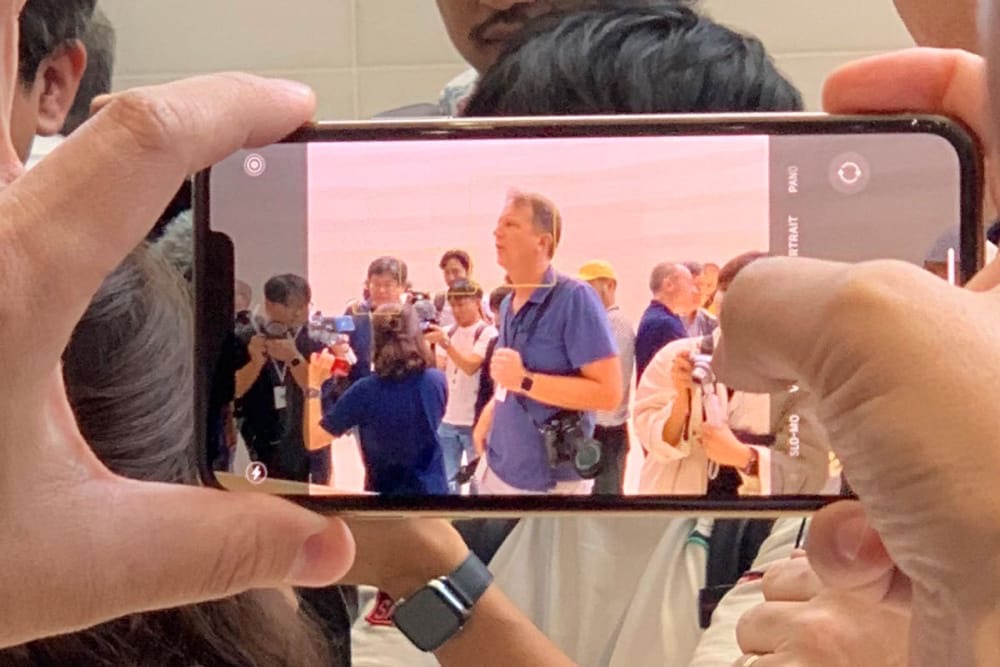

Pour rappel, tous les iPhone 11 disposent d’un ultra grand-angle (0,5x) en plus de leur caméra principale, un « simple » grand angle (1x). L’Appareil photo d’iOS 13 a été modifié pour signaler cet ajout : quand vous prenez une photo avec le grand angle en mode 1x, vous verrez sur les côtés ce que l’ultra grand-angle capte. De quoi réaliser qu’il manque quelqu’un sur une photo de groupe et basculer en mode 0,5x pour inclure tout le monde.

Cette aide est précieuse, mais si vous ne vous rendez pas compte qu’il manque cette personne au moment de prendre la photo, c’est trop tard. Sauf si vous avez activé une option supplémentaire d’iOS 13, qui permet de prendre systématiquement deux photos : une avec le grand-angle classique et une deuxième avec l’ultra grand-angle.

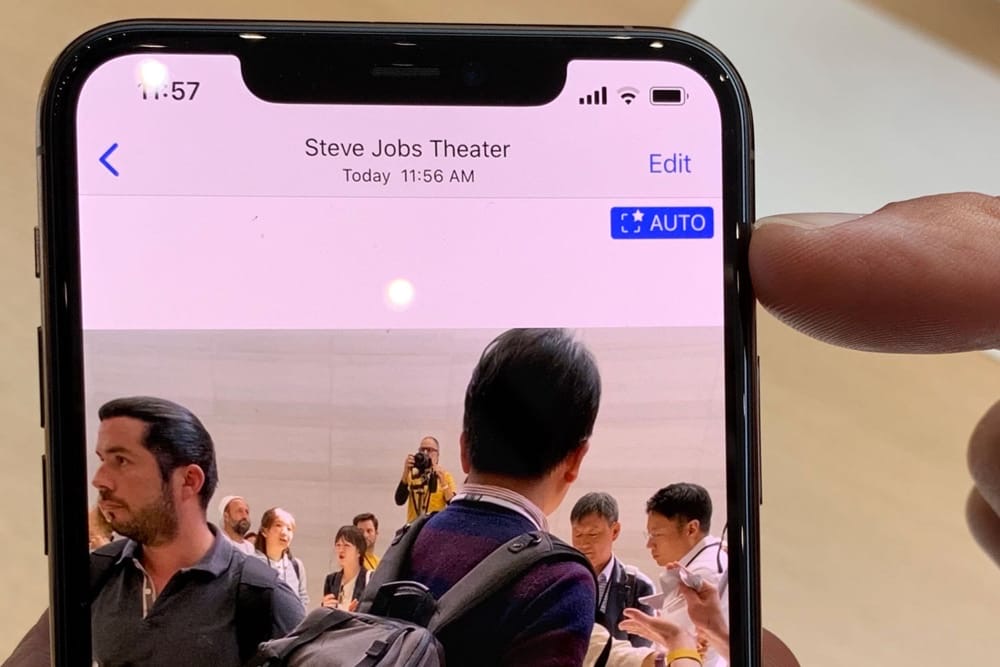

Comme l’indique Jason Snell pour Macworld, cette petite option dans les réglages de l’appareil photo permet de garder une roue de secours pour toutes vos images. Les deux images prises à un angle différent sont conservées pendant quelque temps — on ne sait pas combien exactement — et si vous n’en faites rien, l’app Photos finira par jeter l’image ultra grand-angle pour ne pas encombrer votre espace de stockage sans raison.

Mais si, après avoir pris la photo, vous désirez la recadrer, iOS 13 vous permettra de l’agrandir pour rattraper le coup. L’interface décrite par le journaliste est aussi simple et évidente qu’on pouvait l’imaginer : lors du recadrage, l’app Photos signale l’image plus grande autour de celle que vous avez prise en l’affichant en grisé. Vous pourrez alors glisser les barres blanches vers l’extérieur pour augmenter la taille de l’image et réintégrer ce qui manquait.

Une fois activée, cette option permettra de rattraper le coup pour les photos, mais aussi pour les vidéos. Dans ce cas, les iPhone 11 enregistreront deux flux vidéo de même qualité en même temps, une prouesse assez incroyable qu’Apple avait dévoilée pendant le keynote au sujet d’une app tierce1. On ne savait pas que l’Appareil photo de base pouvait aussi le faire, et que le recadrage des vidéos dans l’app Photos permettra aussi d’agrandir le cadre.

C’est en tout cas une façon très intelligente d’exploiter cette nouvelle caméra ultra grand-angle, même si vous ne l’utilisez pas directement vous-même dans l’appareil photo. Et cette fonction explique probablement pourquoi Apple n’a pas opté pour un téléobjectif avec un niveau de zoom plus élevé sur ses nouveaux iPhone.

-

L’excellente Filmic Pro pourra filmer avec les quatre caméras (celle à l’avant aussi) des iPhone 11 Pro en même temps, et le créateur de la vidéo pourra choisir pendant le montage quel angle il veut conserver. ↩