MacRumors s'intéresse à une poignée de nouveaux brevets Apple rendus publics et concernant l'interface utilisateur de l'iPhone.

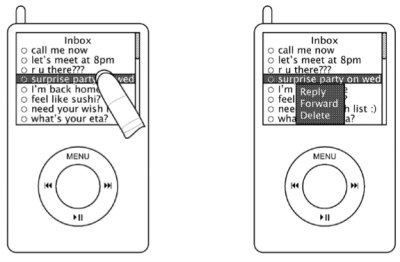

Le premier propose d'utiliser des écrans capables de détecter et de gérer plusieurs types de contacts, soit avec la peau comme c'est aujourd'hui le cas, soit avec une surface non conductrice comme l'ongle ou un stylet par exemple. Il s'agirait ainsi d'augmenter le nombre d'actions possibles. Un tapotement du doigt ferait apparaitre un menu contextuel tandis qu'une pression suivante avec l'ongle permettrait de faire défiler ou de sélectionner l'un de ses éléments. L'aspect pratique de la chose n'est pas évident de prime abord. Avis à ceux qui se rongent les ongles…

L'autre brevet propose d'aider les utilisateurs à apprendre les gestes réalisables sur l'écran tactile pour conduire des actions. Il s'agirait d'afficher des animations, des symboles ou d'utiliser des jeux à visée pédagogiques. En somme un équivalent moderne à la petite pile Hypercard dans les années 80 qui apprenait à l'utilisateur d'un Mac à déplacer sa souris et à sélectionner ou bouger des objets…