Geekbench ML est une nouvelle app des créateurs de Geekbench, solution bien connue de mesure des performances des smartphones, tablettes et autres ordinateurs. Comme son nom le suggère, cette nouvelle app est destinée à mesurer les performances en « machine learning », un apprentissage automatisé qui est devenu central dans l’informatique moderne. L’app est disponible sur iOS et Android, avec des tests qui permettent de comparer les deux plateformes.

Cette première version est numérotée 0.5 pour signaler que c’est une bêta. Les créateurs de Geekbench indiquent dans l’article de blog qui accompagne la sortie de l’app que la version finale devrait sortir d’ici la fin de l’année. D’ici là, le moteur va évoluer rapidement, à tel point que les scores générés ne seront pas comparables d’une version à l’autre. Les résultats générés par l’app aujourd’hui ne seront pas forcément les mêmes que ceux de la prochaine mise à jour.

En revanche, GeekbenchML a été conçue dès le départ pour permettre les comparaisons entre systèmes d’exploitation. Sous le capot, c’est TensorFlow qui a été utilisé pour mesurer les performances. L’app permet de réaliser le test de trois manières : en se basant sur le CPU uniquement, en se basant sur le GPU seulement, ou bien en exploitant toutes les capacités du SoC intégré au smartphone. Sur un iPhone, cela veut dire utiliser CoreML, l’API d’Apple qui exploite le CPU, le GPU et surtout le réseau neuronal des puces maison.

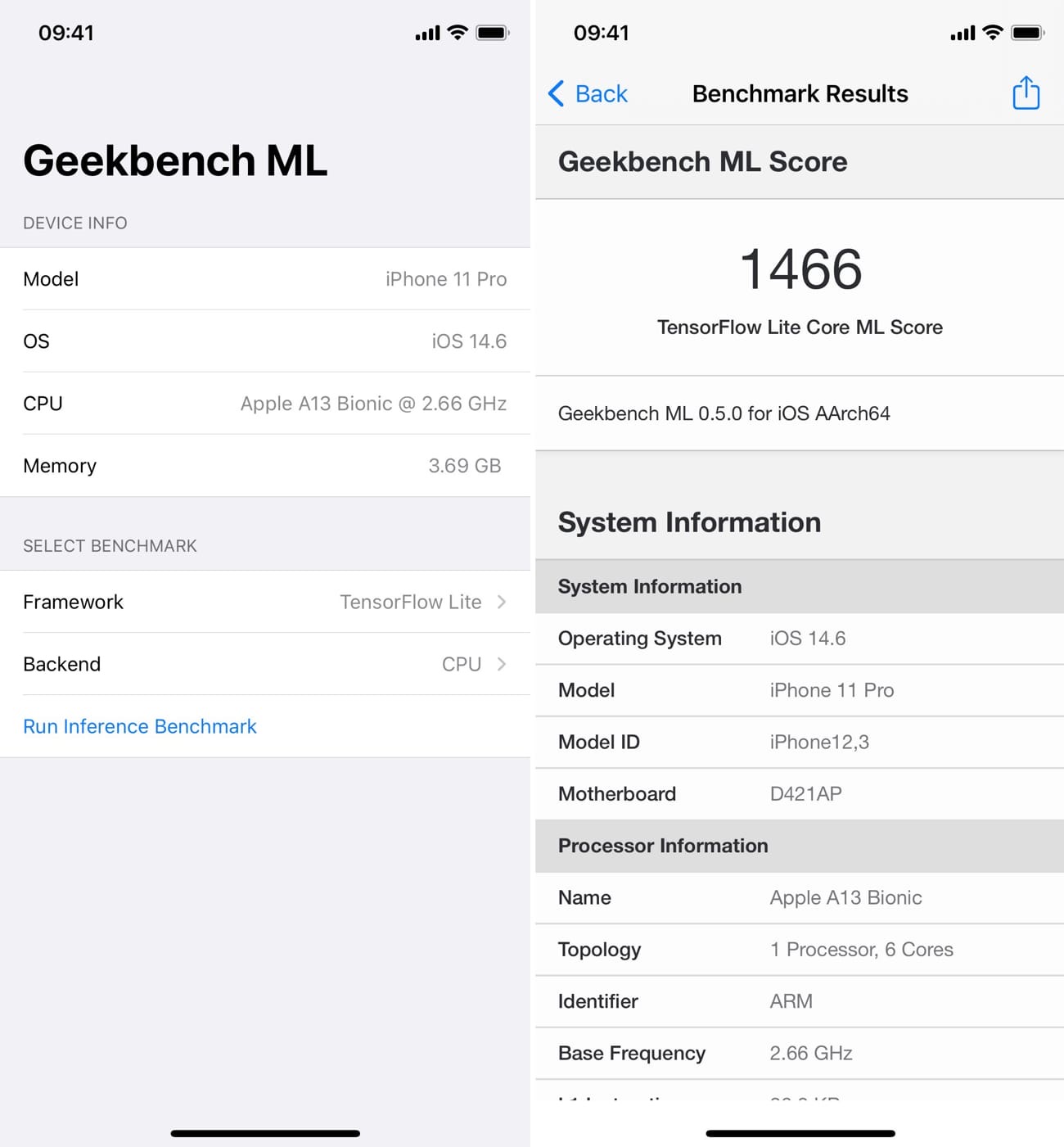

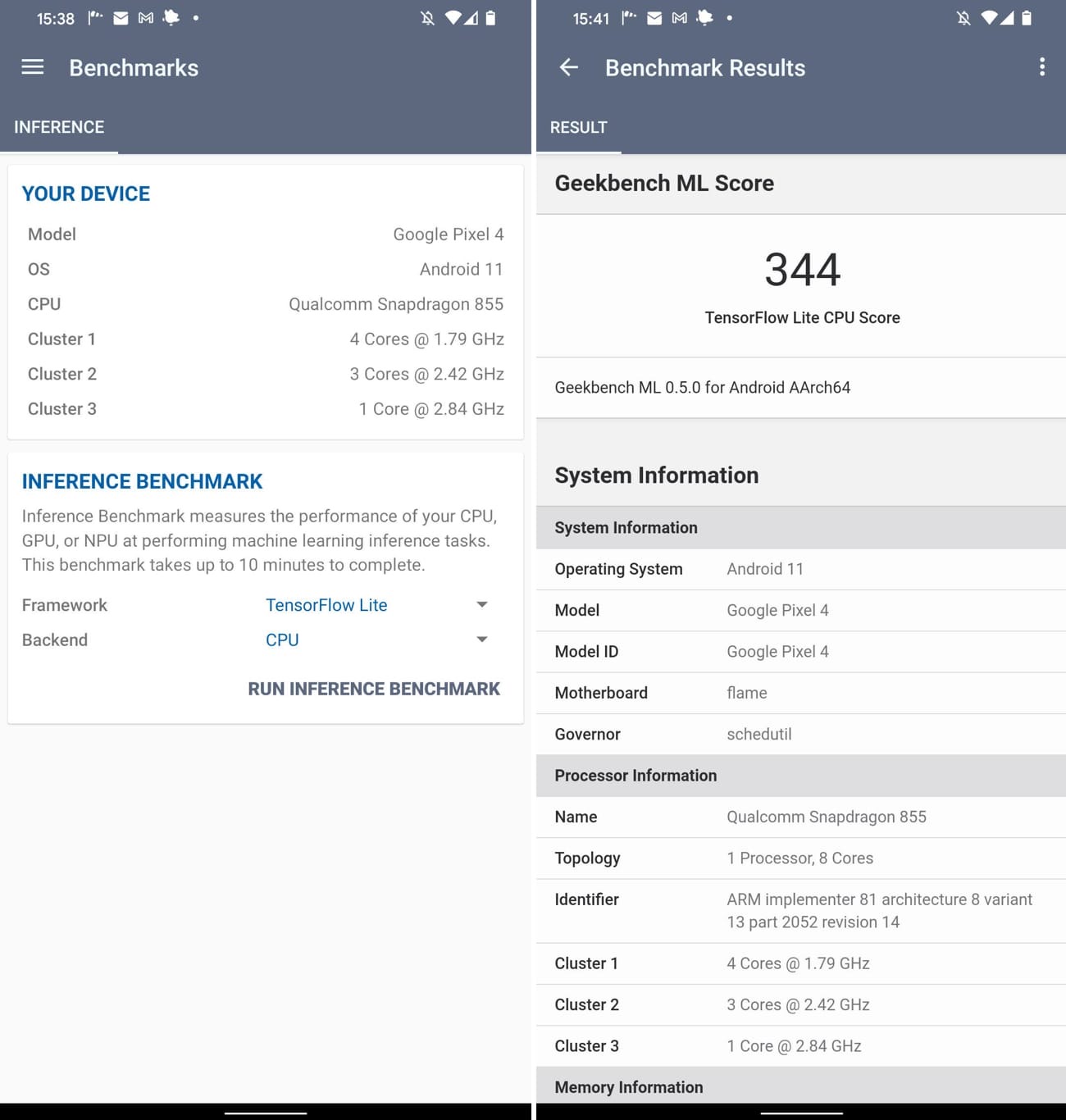

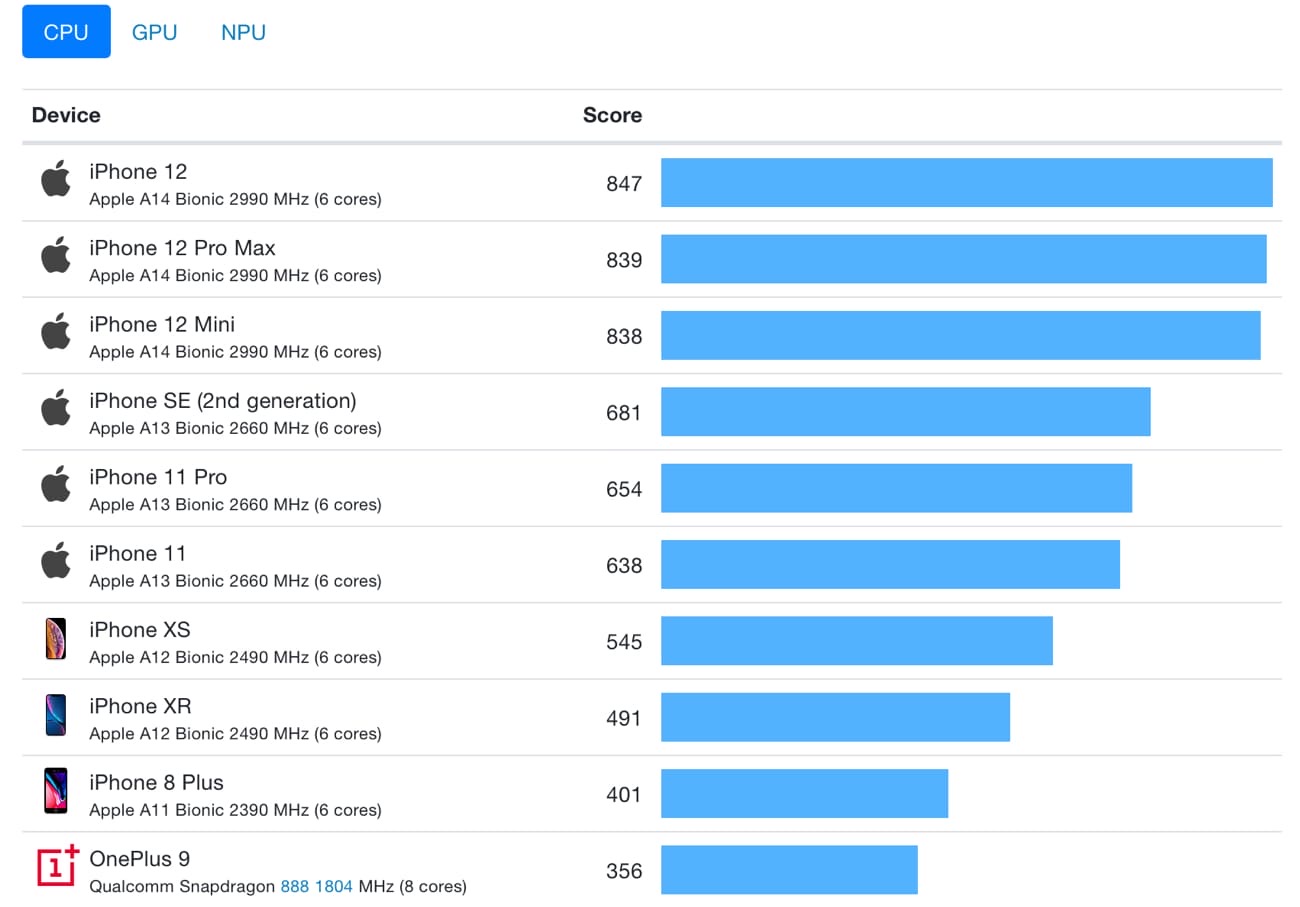

Comme avec Geekbench, les scores peuvent être mis en ligne à la fin. Voici ce que cela donne pour mon iPhone 11 Pro sous iOS 14.6, en faisant travailler uniquement le CPU. Et puisque les scores sont mis en ligne, ils peuvent aussi être comparés : une nouvelle section du site a ainsi été mise en ligne pour collecter les scores générés par l’app. Autant dire que cette comparaison est cruelle pour Android, les iPhone occupent toutes les premières places laissant les meilleurs smartphones concurrents loin derrière.

Pour vous donner un exemple, le OnePlus 9 est le meilleur smartphone Android sur le test basé uniquement sur le CPU et il arrive dixième du classement. Devant lui se trouvent neuf iPhone, de l’iPhone 12 en tête jusqu’à l’iPhone 8 Plus, classé neuvième. Pour le dire autrement, un vaisseau amiral de 2021 équipé du meilleur SoC de Qualcomm (Snapdragon 888) fait moins bien qu’un iPhone sorti en 2017.

Geekbench ML est disponible gratuitement, l’app n’est pas proposée en français et elle nécessite iOS 14.