Mise à jour 17/08 — Le parlement allemand s'est saisi de l'affaire. Le président du comité à l'agenda numérique, Manuel Hoferlin, a envoyé un courrier à Tim Cook pour lui demander de reconsidérer le système de détection des photos pédopornographiques. Apple est sur une « pente dangereuse », tout en compromettant la confidentialité des communications, selon lui. Hoferlin estime que la technologie d'Apple sera « le plus grand instrument de surveillance de l'histoire ». Elle sera lancée d'abord aux États-Unis cet automne.

Article original, 16/08 — La décision d'Apple de mettre en place un mécanisme de détection et de signalement d'images pédophiles commence à provoquer des réactions en Europe. Initialement ce système sera lancé aux États-Unis, Apple ayant indiqué qu'elle ne s'interdirait pas de le lancer dans d'autres pays en fonction des législations locales.

Des associations de journalistes germanophones en Allemagne, en Suisse et en Autriche, s'alarment à l'idée que ce système d'analyse de la base de photos en local sur l'iPhone, avant sa synchronisation en ligne via la fonction Photos iCloud, puisse à terme déborder vers d'autres contenus.

C'est un leitmotiv dans les critiques émises à l'encontre de ce système. On commence avec les photos de pédopornographie et demain, peut-être, Apple se verra sommée par un gouvernement d'étendre ses filets vers les photos de dissidents, de minorités persécutées, etc.

Ces associations s'inquiètent que des informations confidentielles et leur sources, stockées sur les appareils des journalistes, puissent faire un jour l'objet de telles recherches automatisées. Et ce alors que ces médias ont des correspondants basés aux États-Unis. Dans les risques possibles il est aussi évoqué le cas de la Hongrie et du gouvernement Orban dont la politique va ouvertement à l'encontre de la communauté LGBT.

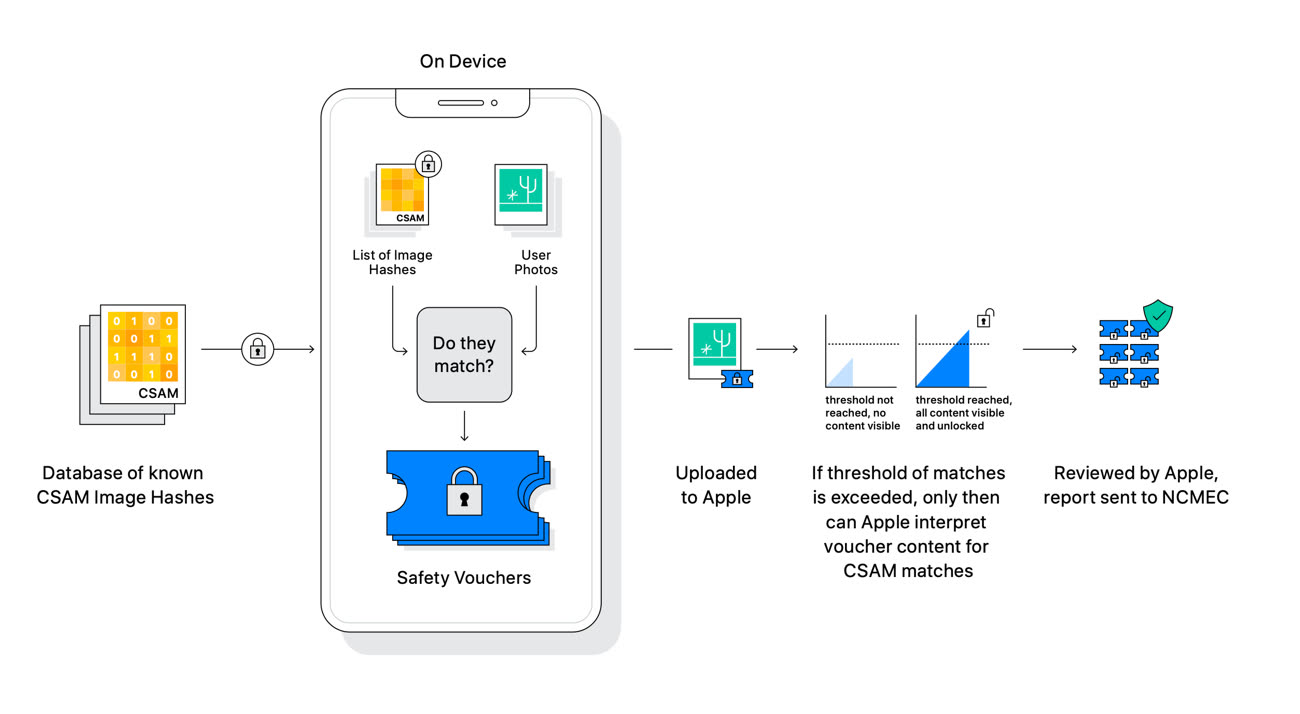

Là encore il y a cette crainte de voir ces gouvernements exiger d'Apple qu'elle ouvre son système plus largement. La Pomme a expliqué que son mécanisme est précisément conçu pour n'être exploitable que dans ce contexte de la lutte contre la pornographie infantile, en liaison exclusive avec une base de donnée spécialisée dans ce domaine.

Craig Federighi reconnait qu'Apple a très mal communiqué sur les mesures de lutte contre la pédopornographie

Apple l'assure, les gouvernements ne pourront pas abuser du nouveau mécanisme de lutte contre la pédopornographie

De même, Apple a assuré qu'elle s'opposerait à toute demande allant dans un sens contraire. Mais elle n'a pas évoqué le cas où un gouvernement irait au-delà d'une requête insistante — comme ce fut le cas avec le FBI pour l'affaire de San Bernardino — et qu'il inscrirait sa demande dans une nouvelle loi.

Ces associations de journalistes demandent à la Commission européenne, aux ministères de l'Intérieur de leurs pays respectifs ainsi qu'aux bureaux en charge du respect du RGPD de s'emparer de ce dossier.