Coup d'œil sur les nouvelles fonctions d'accessibilité d'iOS 16

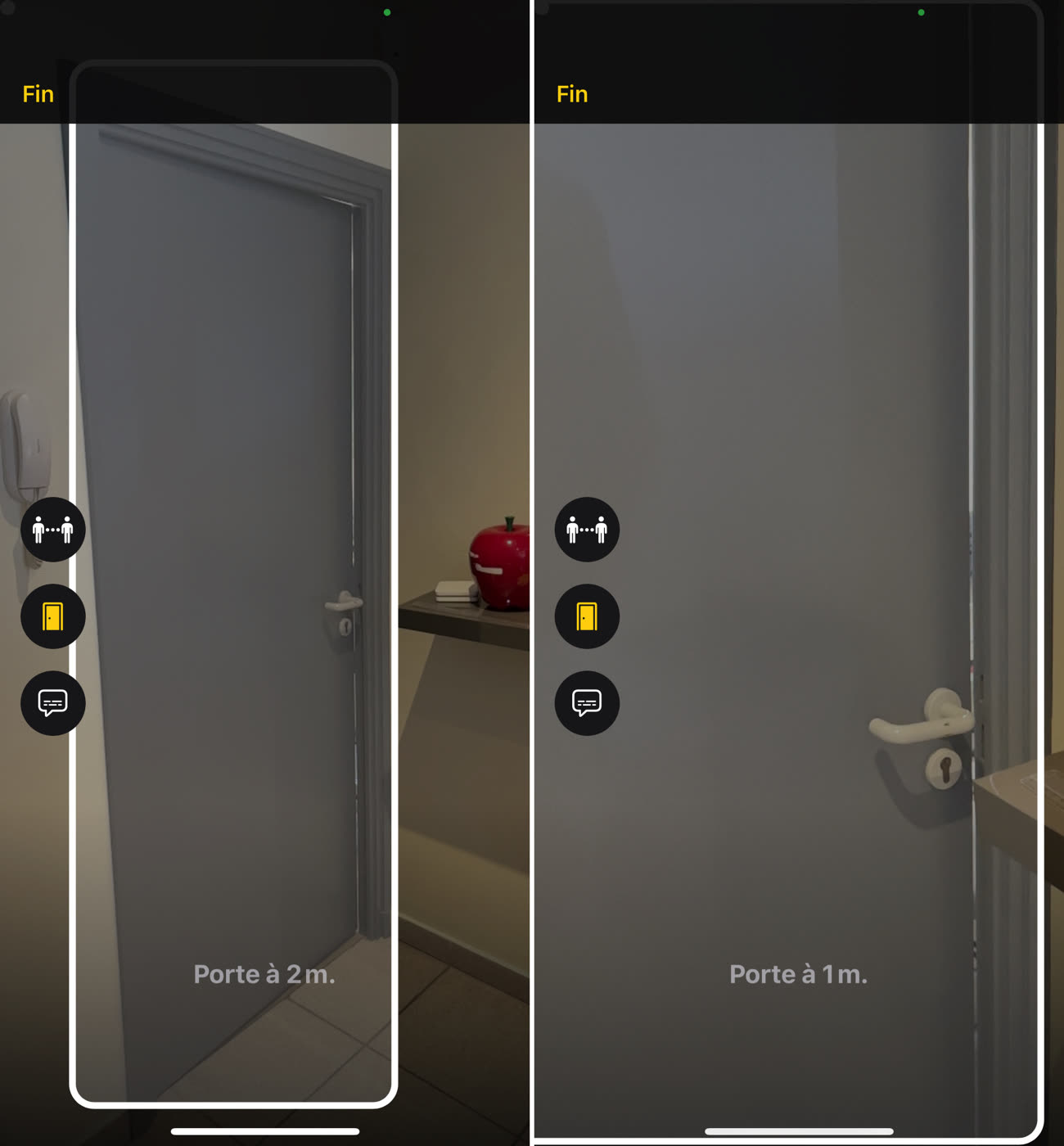

La dernière mouture d'iOS a apporté une poignée de fonctions d'accessibilité, dont une partie a été annoncée au mois de mai à l'occasion de la journée mondiale de la sensibilisation à l’accessibilité. Loupe s'enrichit notamment de plusieurs compétences bien pratiques : elle peut désormais détecter les portes et vous indiquer à quelle distance elles se trouvent de vous.

Selon Apple, cette fonction devrait aussi permettre de « lire les panneaux ou les étiquettes qui entourent la porte et d'obtenir des instructions sur la façon de l'ouvrir ». Ces deux options ne marchent pas encore dans cette bêta. En revanche, l'application peut également détecter si une personne se trouve près de vous et à combien de mètres.

L'autre nouveauté assez impressionnante de Loupe, c'est qu'elle peut désormais vous indiquer quel est l'objet que vous pointez avec votre iPhone. Les résultats sont plutôt bons, même si le moteur interne est évidemment loin d'être exhaustif. Ces fonctions ne sont disponibles que sur les appareils embarquant un capteur LIDAR, à savoir les iPhone 12 et 13 Pro, mais aussi certains iPad Pro récents.

Siri a gagné quelques nouveautés : on pourra définir une durée pendant laquelle l'assistant doit attendre avant de considérer une parole comme terminée. De même, il devrait désormais permettre de raccrocher une communication ou d'annoncer les notifications dans les appareils auditifs MFI.

Autre ajout intéressant : les sous-titres en direct. Cette fonction va transcrire en direct les paroles jouées par l’iPhone (dans une vidéo ou autre), mais aussi vos conversations Facetime. Le texte va être généré dans une petite fenêtre flottante accessible rapidement. Une fonction bien pratique pour les malentendants et qui fait rêver d'un mode similaire embarquant un traducteur en temps réel. Malheureusement, le tout est pour le moment limité à la langue anglaise : il faut passer son téléphone sur la région États-Unis pour débloquer un nouveau taquet dans les Réglages.

Pour les joueurs, une option va permettre de relier plusieurs manettes à un seul appareil pour aider les personnes ayant des difficultés à progresser. L'application Livres a gagné quelques paramètres offrant d'élargir l'espacement entre les caractères ou les lignes.

Apparemment, il y a l’ajout de nouvelle voix de synthèze avec voice over en français. A confirmer, je n’ai pas installer ios 16 cet année, on parle de beaucoup de bug, sa m’a refroidit. Mes apps de tout les jours qui plante aussi.

@bigsteck

iOS 16 n’est pas sorti encore. J’espère bien une tu ne pas pas installer. Il est réservé pour les appareils dédié au test.

je me vois déjà pester "mais enfin, iphone, c'est un module SFP+ 40gbs optique 850nm ! c'est évident!!!!"

@oomu

🤨🤨

Petite question sur le transcript automatisé des vidéos/conversations FaceTime . Fait-il le distinguo entre les voix/personnes, ou l’on juste du texte au kilomètre ?

(Pas encore installé Ventura ou iOS16, j’attends que la Bêta publique sorte, avec les premiers bugs corrigés)

@vincentn

Je vais essayer de faire un papier plus approfondi sur le sujet si ça fonctionne sur cette première beta (j’ai pas réussi à le faire transcrire quoi que ce soit tout à l’heure)

Même si certains font la fine gueule, il faut reconnaître des progrès plutôt sidérants dans l’IE. Le cerveau humain ne va pas tarder à être totalement largué, et c’est logique: multiplication des capacités IE de plus de 10 fois en moins de 10 ans, quand il a fallu au genre humain des millions d’années pour arriver au même résultat. Et on se demanderait même s’il n’y pas régression (humaine).

Sur la photo c’est quoi cette multiprise de ouf!!!???

Je me dis que si on conjugue Loupe avec des lunettes d’AR. Les personnes malvoyantes auraient un nouvel outil pour les accompagner. À voir comment ce sera utilisé et développé!

Je vois un avenir pour le casque AR Apple très centré accessibilité… C’est assez génial…