Quand Google a présenté ses nouveaux Pixel à l’automne, nous avons eu droit à une démonstration d’une fonction de l’appareil photo qui n’était pas encore présente. « Night Sight »1, un mode nuit qui promettait de prendre des photos là où aucun smartphone ne pouvait le faire auparavant, y compris dans le noir quasiment complet. En guise de démonstration, le géant de la recherche avait donné cette comparaison qui avait bluffé tout le monde… et créé quelques sceptiques au passage.

La différence était telle que l’on avait le sentiment que Google avait trafiqué les photos pour creuser l’écart entre son appareil photo et celui d’Apple. L’absence de la fonction au lancement a entretenu ces suspicions, mais l’entreprise a annoncé hier que le mode nuit était finalisé et que tout le monde allait pouvoir le tester. D’ailleurs, la fonction n’est pas réservée aux nouveaux Pixel 3, tous les Pixel, y compris le modèle de 2016, peuvent en bénéficier, via une mise à jour de l’appareil photo qui sera distribuée dans les prochains jours.

Android oblige, il était en fait possible de tester la fonction en avance. Un petit malin avait trouvé comment débloquer la fonction et on pouvait déjà télécharger une version alternative de l’appareil photo, avec Night Sight. C’est ce que j’ai fait dès que j’ai reçu le Pixel 3 XL que je suis en train de tester, et j’ai été impressionné par les résultats.

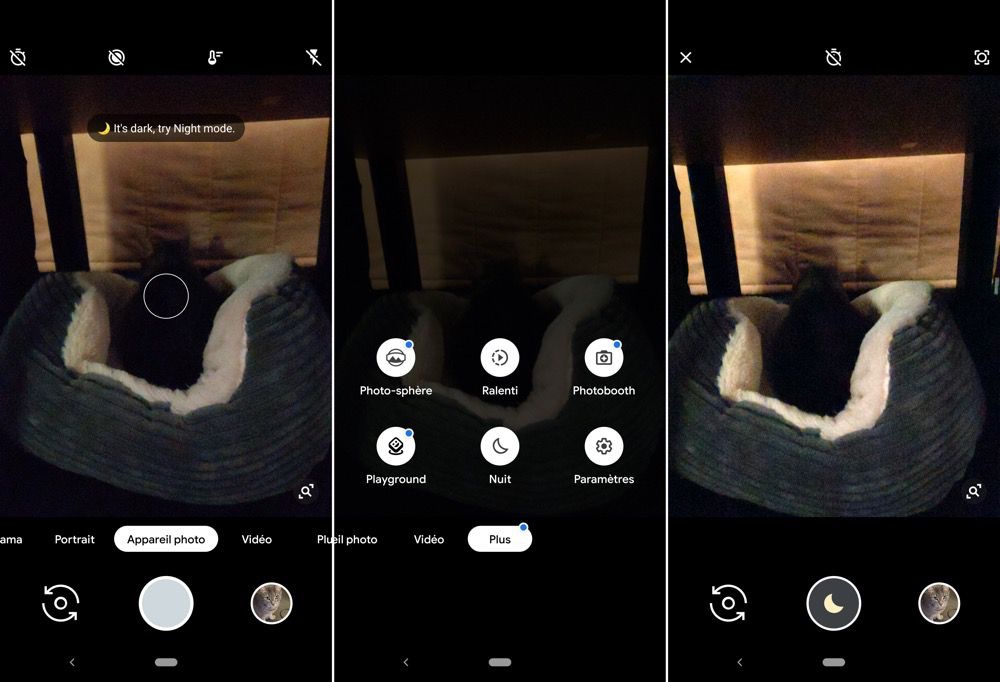

Le mode nuit brille dans certaines situations et échoue parfois spectaculairement dans d’autres. C’est pourquoi il s’agit d’un mode spécifique, que l’utilisateur doit activer, et non d’une option qui s’active automatiquement, comme le mode HDR des smartphones modernes. Quand l’appareil photo juge qu’il n’y a pas assez de lumière, il suggère de l’activer avec un message à l’écran. Si l’utilisateur le souhaite, il peut alors faire défiler la longue liste d’options, toucher « Plus » et activer le mode nuit proposé dans la liste de modes spéciaux.

Les résultats ne sont pas toujours bons, mais il y a un autre point qui peut poser problème : le mode nuit est lent. Comme nous l’avions évoqué dans un précédent article, Google utilise une pose longue pour capter davantage de lumière. La différence, c’est que plusieurs photos (jusqu’à 15) sont combinées pour augmenter la durée de la pose par un savant assemblage. De fait, même si prendre une photo en mode nuit est plus long, il ne faut qu’une seconde ou deux en général, pour obtenir l’équivalent d’une pose de cinq à six secondes.

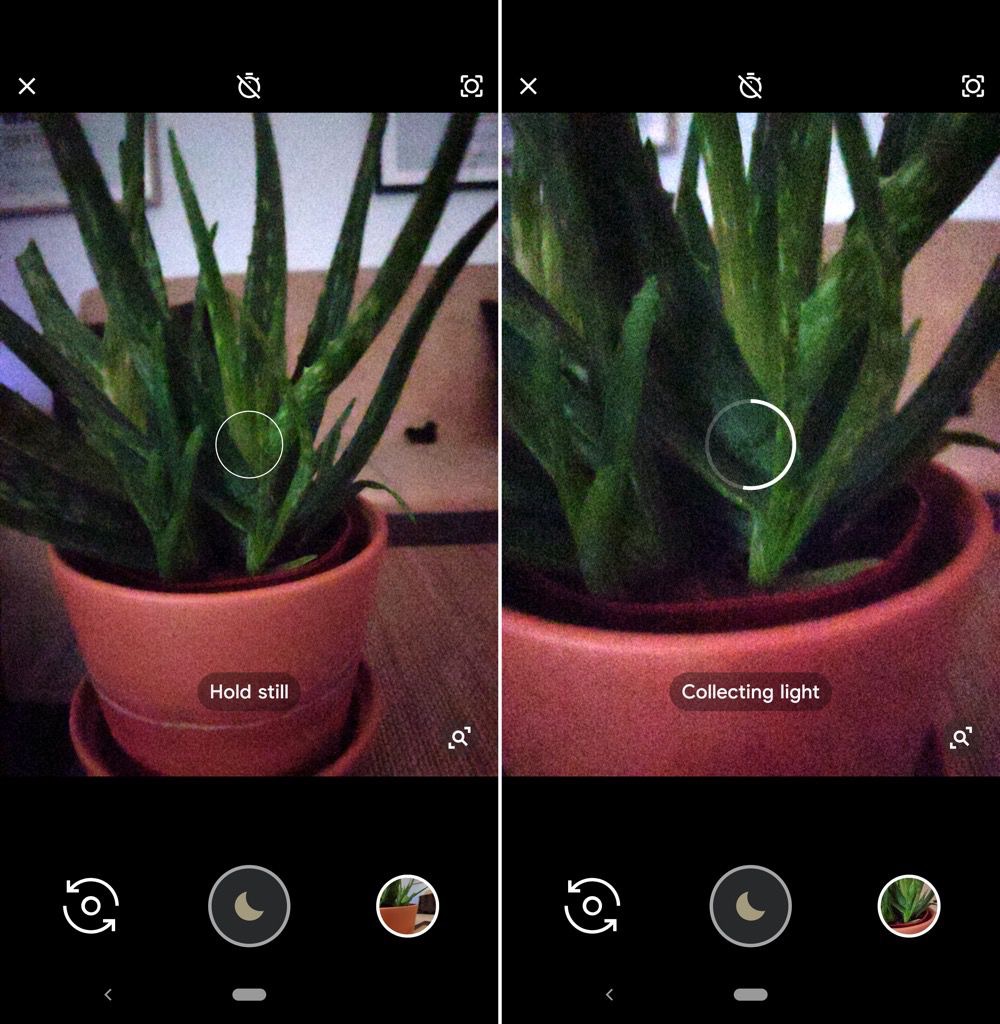

Concrètement, la prise se fait en deux étapes. Dans un premier temps, le Pixel 3 va prendre une photo avec un temps de pose légèrement plus long que la normale. Pendant cette étape, l’appareil vous indique de ne pas bouger, et si vous voulez éviter du flou, il est important de respecter la consigne. De la même manière, tous les objets trop rapides seront flous pour cette raison. Cette étape dure moins d’une seconde en général, et une deuxième suit pour collecter de la lumière. Celle-ci peut durer une à deux secondes, mais elle n’oblige pas à garder le smartphone bien stable, il s’agit uniquement d’enrichir la première photo avec des informations supplémentaires.

Le traitement n’est pas appliqué en direct, il faut deux ou trois secondes de plus pour que Google « prépare » l’image. Tout est effectué en local, grâce à une puce spécifique présente dans les Pixel, mais il faut malgré tout une petite attente pour obtenir la photo finale. Dernier point important à noter, ce qui est affiché au moment de prendre la photo n’a rien à voir avec le résultat final. L’app pousse au maximum la sensibilité pour vous permettre de voir quelque chose et le résultat est très granuleux, mais la photo finale sera meilleure.

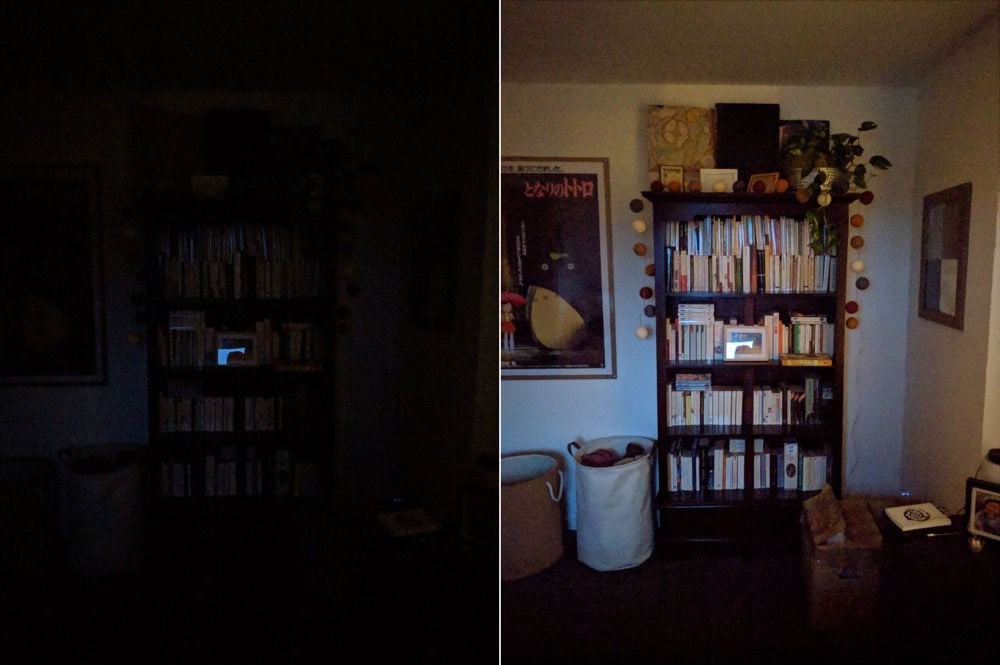

Dans la suite, la photo standard est toujours à gauche, celle en mode nuit est à droite. Toutes les photos ont été prises avec un Pixel 3 XL et avec un mode nuit en bêta.

Assez parlé, que vaut ce mode nuit ? Comme vous pouvez vous en douter, il fonctionne mieux de nuit, surtout dehors. Dans ce cadre, on obtient des photos spectaculaires, avec parfois le sentiment étrange qu’il faisait encore un petit peu jour. Il faut dire que Google utilise de l’intelligence artificielle pour la balance des blancs, avec parfois des résultats étranges, comme ce ciel bien bleu alors que l’on était en pleine nuit.

Même s’il ne fait pas totalement nuit, ce mode peut améliorer des photos, ou en tout cas offrir une version plus lumineuse, plus nette et avec moins de grain. Ces photos prises au petit matin en témoignent bien.

J’ai surtout utilisé le mode nuit en intérieur néanmoins, et même dans ce cadre, on peut obtenir des résultats assez bluffants. Les photos en mode nuit sont plus lumineuses, naturellement, mais aussi souvent plus justes en termes de colorimétrie, avec une balance des blancs qui évite les couleurs trop chaudes de l’appareil photo classique.

Même si les conditions lumineuses sont bonnes, le mode nuit offre parfois une meilleure balances des blancs, en tout cas un rendu moins jaune. Comme Google l’explique, son mode nuit essaie de tenir compte des éclairages et de restaurer les couleurs de jour, ce qui veut souvent dire limiter la teinte jaune que l’on a de nuit. Sur ces exemples, cela permet aussi d’obtenir un blanc moins jaune, tout en améliorant aussi la netteté de l’image.

Google indique qu’il faut un petit peu de lumière pour que le mode nuit fonctionne, mais il en faut en fait très peu. Si vous n’avez pas peur d’avoir du grain numérique, vous pouvez prendre des photos quasiment dans le noir et obtenir un résultat qui est loin d’être parfait, mais qui peut servir. Ce sont des cas où je n’aurais même pas imaginé prendre une photo avant, le résultat à cet égard est impressionnant.

Le mode nuit fonctionne également avec les selfies, à condition de ne pas trop bouger et de ne pas essayer dans le noir. Le capteur avant est moins bon, ce qui veut dire que Google ne peut pas utiliser une pause aussi longue et les résultats souvent nettement moins bons. Vous pourrez obtenir une image plus nette, mais la peau est lissée de manière agressive et le grain revient vite… pas de miracle, le capteur au dos est plus adapté au mode nuit.

Le mode nuit ne donne pas toujours de bons résultats. Si votre sujet bouge beaucoup, comme un chat par exemple, vous risquez d’obtenir une série de photos floues sans grand intérêt. Et il y a quelques situations qui ne donnent pas de bons résultats, notamment des photos prises dans le noir, avec des LED. On obtient une image baveuse, tout juste bonne à jeter.

Pour conclure, le mode nuit apporte une souplesse jamais vue sur un smartphone auparavant. Ce n’est pas de la magie, mais Google profite de son avance en matière de photographie informatisée pour offrir une fonction très difficile à mettre en place auparavant. Des apps tierces pouvaient déjà faire des poses longues, certaines comme Hydra ont même déjà exploité l’idée de combiner plusieurs photos en une seule pour capter plus de lumière, mais les résultats sont très inférieurs.

Le Pixel 3 ne se contente pas d’assembler plusieurs images ensemble, il collecte aussi davantage de lumière après avoir pris la photo, et surtout il applique une montagne de traitements et d’intelligence artificielle. En comparant le mode nuit de Google au mode basse luminosité de Hydra qui combine dix images, la différence est nette, surtout quand la photo est prise dans la pénombre. Ajoutons que l’app pour iPhone ne gère pas du tout les mouvements, alors que le géant de la recherche sélectionne une image clé pour aligner toutes les suivantes.

Bref, ce n’est pas de la magie, mais c’est un outil supplémentaire très simple à utiliser et qui pourra sauver bien des photos. Google a pris de l’avance dans le domaine, mais on ne serait pas surpris qu’une fonction similaire arrive chez Apple (et les autres) dans les prochaines années.

Pour en savoir plus sur Night Sight et obtenir quelques conseils pour avoir de meilleurs résultats avec un Pixel et son mode nuit, le blog de Google offre de nombreuses précisions supplémentaires. Les Pixel 3 sont disponibles en France à partir de 859 €.

-

En français, le mode « Vision de nuit », mais la suite de l’article évoquera simplement le mode nuit. ↩︎