Parmi les nombreuses nouveautés d’iOS 11, Apple ouvre aux développeurs les données de distance captées par les deux appareils photos de l’iPhone 7 Plus. Avec iOS 10, cette information servait uniquement pour le mode portrait, cet effet de profondeur qui floute l’arrière-plan pour mettre en valeur un sujet.

Désormais, les informations fournies par les capteurs seront accessibles par tous les développeurs qui le souhaitent. Ce qui veut dire qu’une app tierce pourra reproduire l’effet intégré par Apple dans l’appareil photo d’iOS. Mais cela devrait permettre aussi de nouveaux usages qui restent à inventer.

En attendant, iOS 11 offre au passage un petit peu plus de souplesse aux photos prises en utilisant le mode portrait. L’information sur les distances calculées, et donc les différents plans dans le cadre, est désormais enregistrée directement dans le fichier. C’est l’une des nombreuses options offertes par HEIF, le nouveau format d’image utilisé par Apple (lire : HEIF : comment Apple abandonne JPEG).

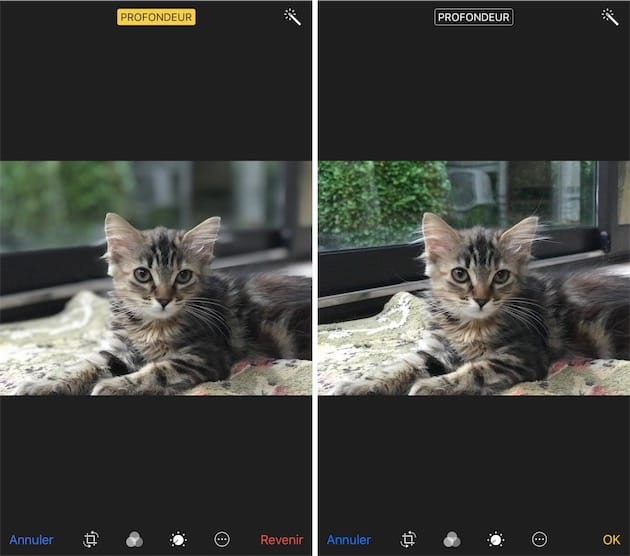

De ce fait, l’effet de profondeur d’iOS 11 n’est plus destructeur comme il l’était avec iOS 10. Concrètement, cela veut dire qu’il est possible de revenir en arrière a posteriori et de désactiver l’effet de flou sur l’arrière-plan à tout moment. Lors de l’édition d’une image, un bouton « Profondeur » est affiché en haut de l’écran et vous pourrez le toucher pour (dés)activer l’effet à l’envie. Cette option est aussi proposée sur l’iPad avec iOS 11 et même sur Mac, avec High Sierra.

Conséquence logique de ce changement, Apple ne duplique plus les images prises avec le mode portrait. Avec iOS 10, on obtenait par défaut deux images : une normale, et une avec l’effet de profondeur. Il fallait ensuite nettoyer ses photos en fonction du résultat et supprimer l’une ou l’autre, ou alors choisir de ne garder que le mode portrait, avec le risque d’avoir des photos ratées. Cette option a été retirée et la solution d’iOS 11 est bien supérieure.

Au passage, l’effet de profondeur a été amélioré avec iOS 11 d’après Apple. Ce mode portrait n’est plus en bêta, mais pour le reste, il est parfois difficile d’en juger sans avoir deux iPhone 7 pour prendre les mêmes photos avec les deux versions du système. Voici quelques exemples réalisés avec iOS 11 pour vous donner une idée du résultat à attendre.

La détection des bords pose toujours parfois problème, mais c’est un petit peu mieux. Malgré tout, il est facile de « tromper » l’effet : il manque des feuilles sur la photo avec la maison en arrière-plan et le haut du mât du bateau a été largement effacé. Le découpage des poils de chats manque aussi encore de finesse.

Comme avant, le résultat est bien meilleur quand les conditions lumineuses sont bonnes. Sur cette autre photo végétale, le soleil sur les feuilles améliore considérablement le rendu de l’effet. Néanmoins, le grain toujours bien présent quand les conditions lumineuses se détériorent semble mieux maîtrisé. Sur la deuxième photo prise en intérieur, l’arrière-plan est moins grossier que par le passé.