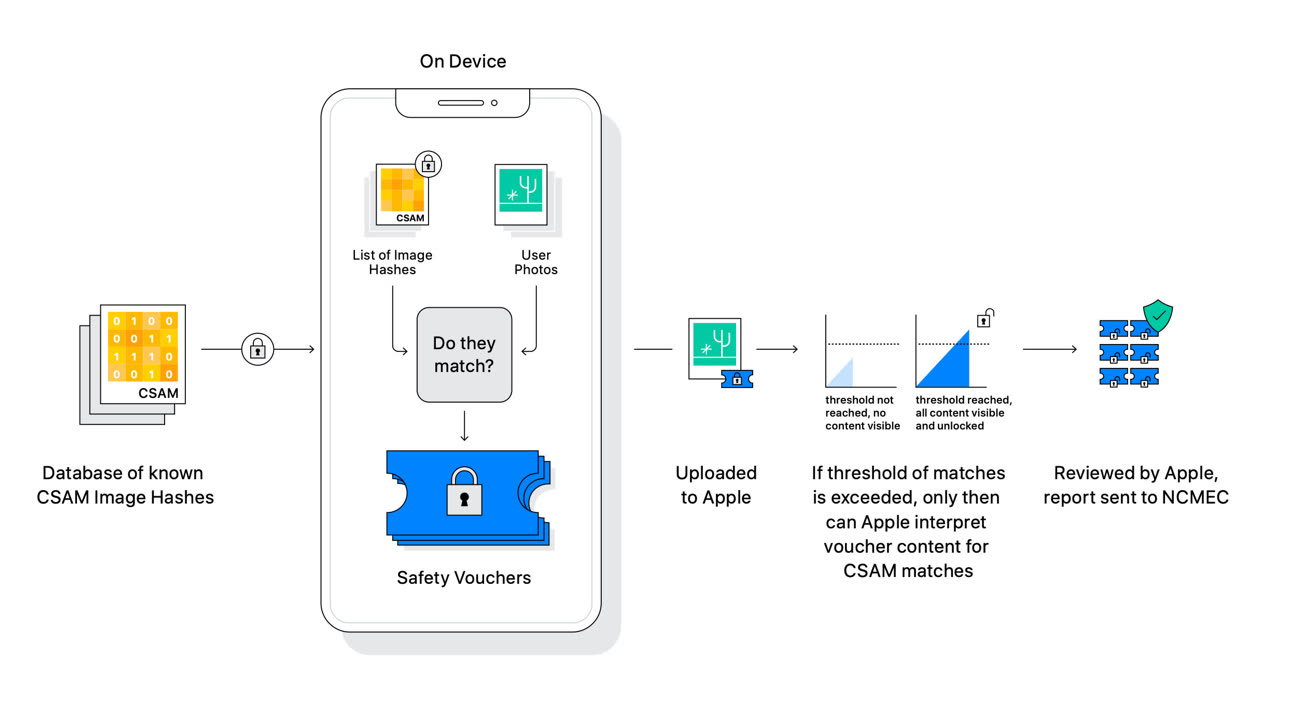

On ne choisit jamais la saga de l’été : les mesures de protection contre la pédopornographie annoncées par Apple qui ont été plutôt mal accueillies par les experts et les utilisateurs semblent faire aussi controverse au sein du géant californien. Selon Reuters, des employés ont manifesté leur inquiétude en postant plus de 800 messages sur un canal de discussion Slack interne, bien que les messages en question n'aient pas émané de spécialistes de la sécurité et de la vie privée chez Apple.

Les inquiétudes semblent largement rejoindre ce qui a déjà été avancé jusqu’ici par les défenseurs de la vie privée, c’est-à-dire que des gouvernements moins scrupuleux pourraient détourner ce mécanisme pour passer au crible des images politiquement sensibles n’ayant aucun rapport avec la pédopornographie. De son côté, Apple soutient qu’elle refusera de telles demandes si elles ne concernent pas des photos CSAM (Child Sexual Abuse Material).

Au-delà des implications de cette potentielle boîte de Pandore, il est intéressant de constater comment les employés d’Apple continuent à faire entendre leur voix malgré une culture d’entreprise historiquement centrée sur le secret. Si ce phénomène n’est pas nouveau (les employés en question ont toujours communiqué entre eux sur des réseaux internes, y compris avant les réseaux sociaux et l’extrême médiatisation d’Apple), il a pu être facilité par la généralisation de certains outils de communication.

À titre d’exemple, Apple utilise Slack à l’échelle de l’entreprise depuis quelques années, et d’autant plus depuis l’arrivée nécessaire du télétravail. L’occasion pour les employés de mener des conversations légères… et d’autres moins.

Source :