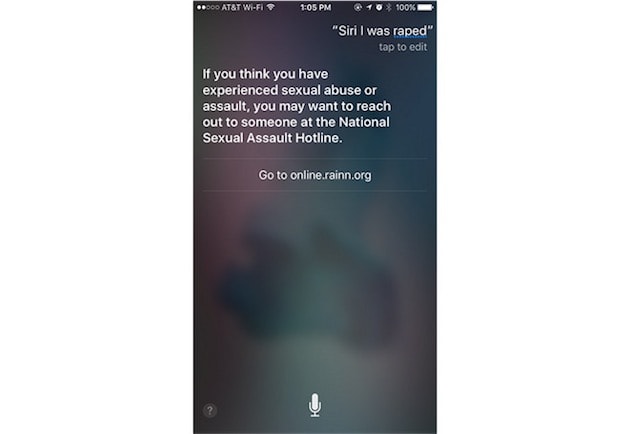

Mi-mars, des chercheurs universitaires ont publié une étude révélant que Siri et les autres assistants personnels ne savaient pas toujours quoi répondre à une personne en détresse.

Apple a réagi promptement en adaptant Siri aux cas de figure qui avaient été omis. Depuis le 17 mars, Siri comprend les phrases « I was raped » (« j'ai été violé ») et « I am being abused » (« j'ai été agressé »), et y répond en proposant d'appeler une association d'aide aux victimes.

Apple a également pris contact avec l'une de ces associations pour perfectionner les autres réponses. Siri se montre par exemple plus délicat : plutôt que de répondre « you should reach out to someone » (« vous devriez contacter quelqu'un »), l'assistant déclare « you may want to reach out to someone » (« vous pourriez contacter quelqu'un »).

Ces changements ont uniquement été appliqués au Siri anglophone. En français, Siri est toujours désemparé quand on lui dit « j'ai été violé » ou « j'ai été agressé ».

Source :