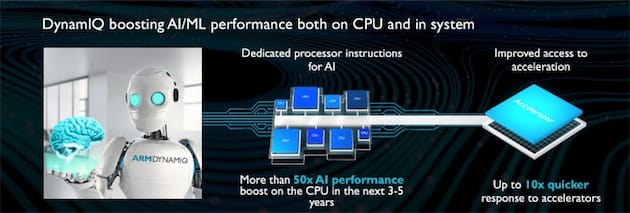

C’est une annonce qui tombe à pic : alors qu’on apprenait en fin de semaine dernière qu’Apple serait en train de développer une puce spécifique pour l’intelligence artificielle, ARM vient de dévoiler une nouvelle technologie, DynamIQ, apportant des progrès significatifs dans ce domaine.

L’entreprise qui conçoit le design de base des processeurs utilisés par quasiment toute l’industrie mobile assure que les performances en intelligence artificielle seront multipliées jusqu’à 50 fois au cours des 3 à 5 prochaines années par rapport aux puces actuelles. Autre promesse, une communication jusqu’à 10 fois plus rapide entre le CPU et les accélérateurs matériels spécialisés du système sur puce.

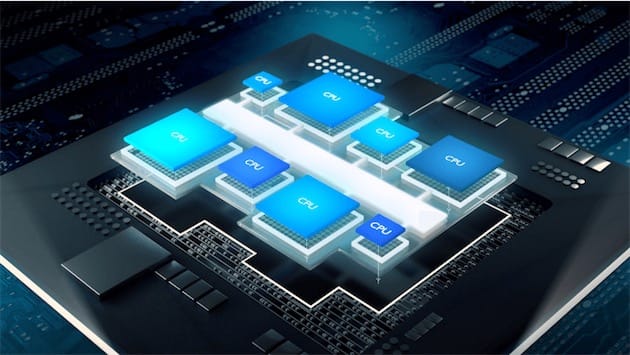

DynamIQ change aussi du tout au tout la façon dont sont gérés les multiples cœurs des processeurs. Alors que l’architecture actuelle big.LITTLE fait fonctionner les cœurs par paire (typiquement 2 cœurs basse consommation et 2 cœurs haute performance), DynamIQ donne plus de souplesse ; il est possible d’avoir une configuration avec jusqu’à 8 cœurs hétérogènes. Par exemple, 1 cœur haute performance accompagné de 7 cœurs basse consommation, ou bien 2 cœurs puissants et 4 cœurs économiques.

ARM s’attend à ce que les premiers smartphones exploitant ses plateformes Cortex-A75 et Cortex-A55 (les premières à être compatibles avec DynamIQ) arrivent au premier trimestre 2018, voire un peu avant.

Il sera intéressant de voir comment les fabricants exploitent ces nouvelles possibilités, notamment Apple qui personnalise déjà largement les solutions d’ARM et qui voudrait donc mettre les bouchées doubles sur l’intelligence artificielle.