À en croire Apple, les animojis ne sont pas possibles sans la caméra TrueDepth bardée de capteurs de l’iPhone X :

La caméra TrueDepth donne vie aux emoji de manière aussi fun qu’inédite avec les animoji. En exploitant la puce A11 Bionic, la caméra TrueDepth capture et analyse plus de 50 mouvements des muscles faciaux, puis reproduit ces expressions sous forme d’une douzaine d’animoji différents.

Et pourtant, comme le relève le youtubeur Marques Brownlee, il semble que les animojis n’exploitent que la caméra avant de l’iPhone X. Tous les composants autour (caméra infrarouge, illuminateur infrarouge, projecteur de points…) ne sont apparemment pas utilisés.

Vous pouvez faire le test : masquez tous les capteurs de l’ensemble TrueDepth à l’exception de la caméra, et vous verrez que les animojis suivent toujours vos grimaces. Nous n’avons pas constaté de dégradation de la reconnaissance en obstruant tous les capteurs secondaires.

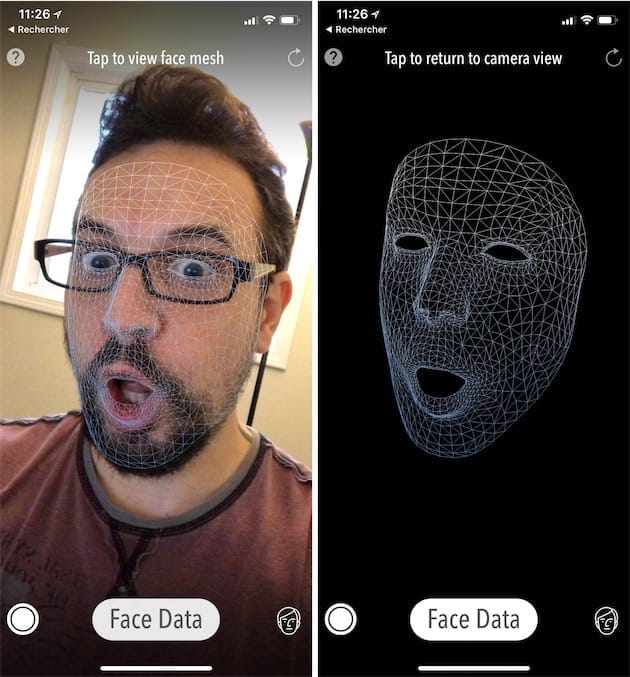

C’est pareil avec la reconnaissance faciale dans l’application tierce AR MeasureKit : l’iPhone X peut toujours cartographier votre visage sans les capteurs secondaires. Mais peut-être que l’application ne tire pas parti de toutes les possibilités offertes par Apple ou ne montre pas les informations recueillies par les capteurs annexes. Dans la documentation dédiée aux développeurs, Apple indique en effet que les apps tierces peuvent exploiter « toutes les capacités de la caméra TrueDepth. »

Quoi qu’il en soit, en l’état actuel des choses, il semble que les animojis pourraient tout à fait être disponibles sur l’iPhone 8 et l’iPhone 8 Plus qui ont la même caméra avant que l’iPhone X. La reconnaissance 3D est sans doute assurée par le capteur de détection de distance par mesure du temps de vol qui figure aussi bien sur l’iPhone X que sur les iPhone 8. Contactée par The Next Web, Apple n’a pas (encore) fait de commentaire.

[MàJ 15/11/2017 18h03] : René Ritchie vient apporter des précisions sur le fonctionnement des animojis et des autres apps de suivi du visage sur l'iPhone X. Le journaliste a obtenu une confirmation de la part d'Apple : le système TrueDepth est bien utilisé pour les animojis, mais pas systématiquement.

Quand on enregistre un animoji, l'iPhone X utilise bien initialement un nuage de points en trois dimensions créés par les mêmes capteurs à infrarouges utilisés par Face ID. Néanmoins, le suivi des mouvements du visage se fait ensuite avec la caméra avant, sans utiliser TrueDepth. Par la suite, Apple exploite de temps en temps les données en trois dimensions pour ajuster le suivi, mais c'est bien la caméra avant qui travaille en majorité.

De ce fait, les animojis pourraient effectivement être adaptés à d'autres iPhone, par exemple aux iPhone 8. Apple a privilégié un meilleur suivi du visage au détriment de la compatibilité, comme elle avait réservé l'enregistrement vidéo à l'iPhone 3GS, comme rappelle René Ritchie.

Reste maintenant à savoir comment se comporterait un iPhone sans True Depth… on peut certainement compter sur les développeurs/bricoleurs pour trouver comment adapter les animojis aux autres appareils iOS !