L’intelligence artificielle a besoin d’un peu d’huile de coude humaine pour lubrifier ses neurones. Amazon emploie des milliers de personnes dans le monde pour littéralement écouter aux portes des utilisateurs d’Alexa, raconte aujourd’hui Bloomberg.

Ces équipes sont chargées de transcrire et annoter les enregistrements audio des possesseurs d’enceintes Echo et consorts. Il s’agit d’abord de s’assurer qu’Alexa a bien compris les requêtes et a apporté une réponse satisfaisante. Ce travail de scribe permet aussi de nourrir la petite cervelle de l’assistant, d’améliorer sa compréhension du discours humain et in fine, de l’aider à mieux répondre aux ordres.

Le boulot est confié à des employés d’Amazon et à des intérimaires, qui travaillent à Boston, au Costa Rica, en Inde ou encore en Roumanie. Pendant neuf heures par jour, ces salariés écoutent jusqu’à mille clips audio. Dans un exemple donné par la publication, un employé a relevé les occurrences de « Taylor Swift » dans les ordres vocaux des utilisateurs d’Alexa.

Il arrive aussi à ces forçats de tomber sur des enregistrements qui sortent de l’ordinaire, comme une chanson massacrée par une utilisatrice sous sa douche, ou encore les pleurs d’un enfant. Les équipes partagent parfois des extraits sur leur messagerie interne… Dans les cas plus sérieux comme des enregistrements d’agression sexuelle, les employés doivent se débrouiller avec leur conscience bien qu’Amazon assure que des procédures sont en place.

Cette histoire rappelle celle des grandes oreilles de Ring qui, elles aussi, ont accès aux enregistrements vidéo des sonnettes connectées acquises par Amazon (lire : Les employés de Ring ont pu espionner les sonnettes et caméras de leurs utilisateurs). Le géant du commerce en ligne se défend de tout espionnage, et explique que ces annotations ne concernent qu’un tout petit échantillon des enregistrements audio d’Alexa.

Ces opérations sont effectuées pour « améliorer l’expérience des consommateurs », assure Amazon. « Par exemple, ces informations nous aident à entraîner nos systèmes de reconnaissance vocale et de compréhension du langage. Alexa peut ainsi mieux comprendre les requêtes, et s’assurer que le service fonctionne bien pour tout le monde ». L’entreprise ressert le couplet des garde-fous et de sa tolérance zéro pour les abus, et assure de son engagement pour la sécurité et la confidentialité de ses clients.

Les employés n’ont pas accès aux informations qui permettraient d’identifier les utilisateurs, et « toutes les données sont traitées avec un haut degré de confidentialité ». Malgré tout, Bloomberg a obtenu une capture d’écran sur laquelle figurait un numéro de compte, le prénom de l’utilisateur ainsi que le numéro de série de l’appareil.

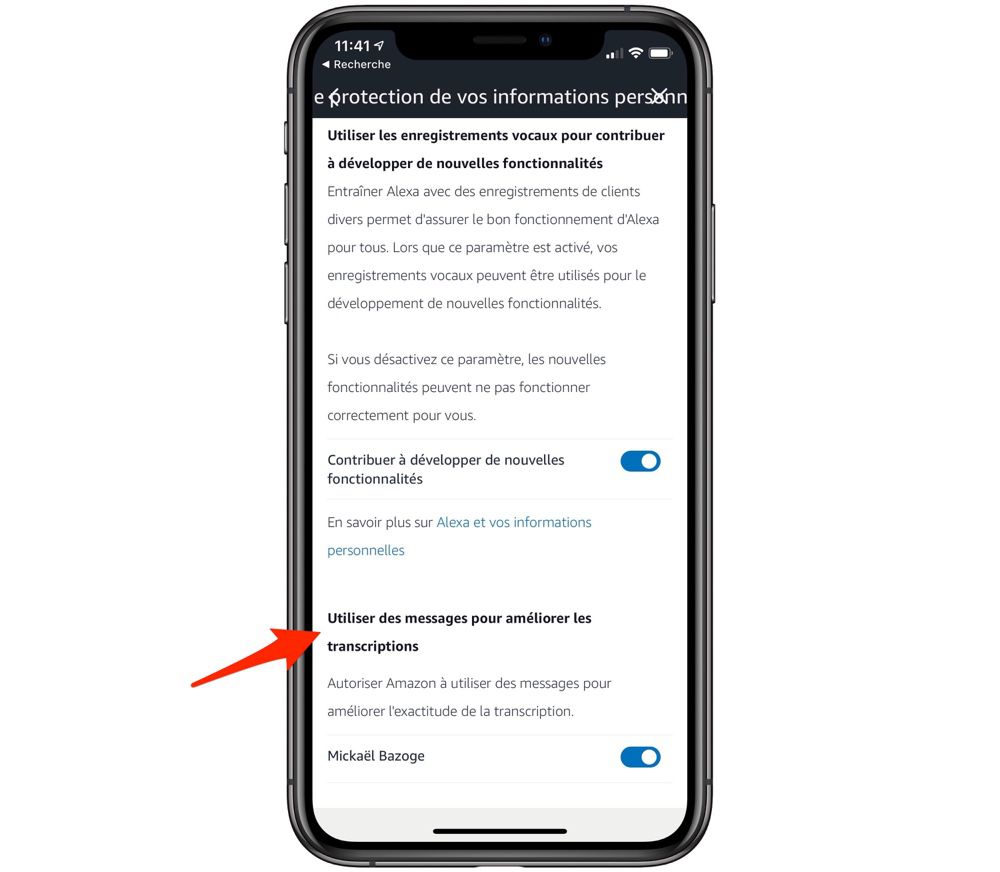

Il existe une option dans les réglages d’Alexa qui désactive la possibilité d’utiliser des messages pour améliorer les transcriptions, mais Amazon reconnait que des enregistrements provenant de ces utilisateurs peuvent toujours être analysés par ses équipes.

Les enregistrements transcrits par les petites oreilles humaines d’Amazon sont les requêtes des utilisateurs lancés après avoir dit le mot magique « Alexa » (ou un autre déclencheur). Alexa peut toutefois s’activer sans y être invitée, par exemple via un mot entendu de travers. Les employés d’Amazon, qui sont tenus de retranscrire tous les bouts d’enregistrement, peuvent tomber chacun sur une centaine de ces extraits non désirés par jour.

Les algorithmes ont besoin de mieux connaitre les spécificités des langages, ce qui permet par exemple à l’assistant d’Amazon de distinguer les mots « avec ça » du déclencheur « Alexa » (lire : Apprendre le français à Alexa n'a pas été chose facile pour Amazon).

Apple fait d’ailleurs de même pour Siri : des humains écoutent des extraits audio impossibles à identifier, qui sont stockés pendant six mois avec un identifiant aléatoire. Ensuite, l’enregistrement peut être conservé pendant deux ans, mais sans aucun identifiant, selon le livre blanc sur la sécurité édité par Apple.

Google pratique de la même manière pour son Assistant, mais les extraits audio ne sont pas associés avec un identifiant.