La liste de nouveautés présentées hier par Apple est longue, mais celle-ci a le potentiel de devenir le nouveau « Texte en direct ». L’app Photos analyse vos images en quête de leur contenu et avec iOS 16 et macOS 13, elle franchit une étape supplémentaire en permettant d’extraire (presque) n’importe quel élément de (presque) n’importe quelle photo. Touchez l’élément que vous souhaitez extraire, maintenez le doigt une seconde et vous pouvez le glisser/déposer n’importe où ! 🤯

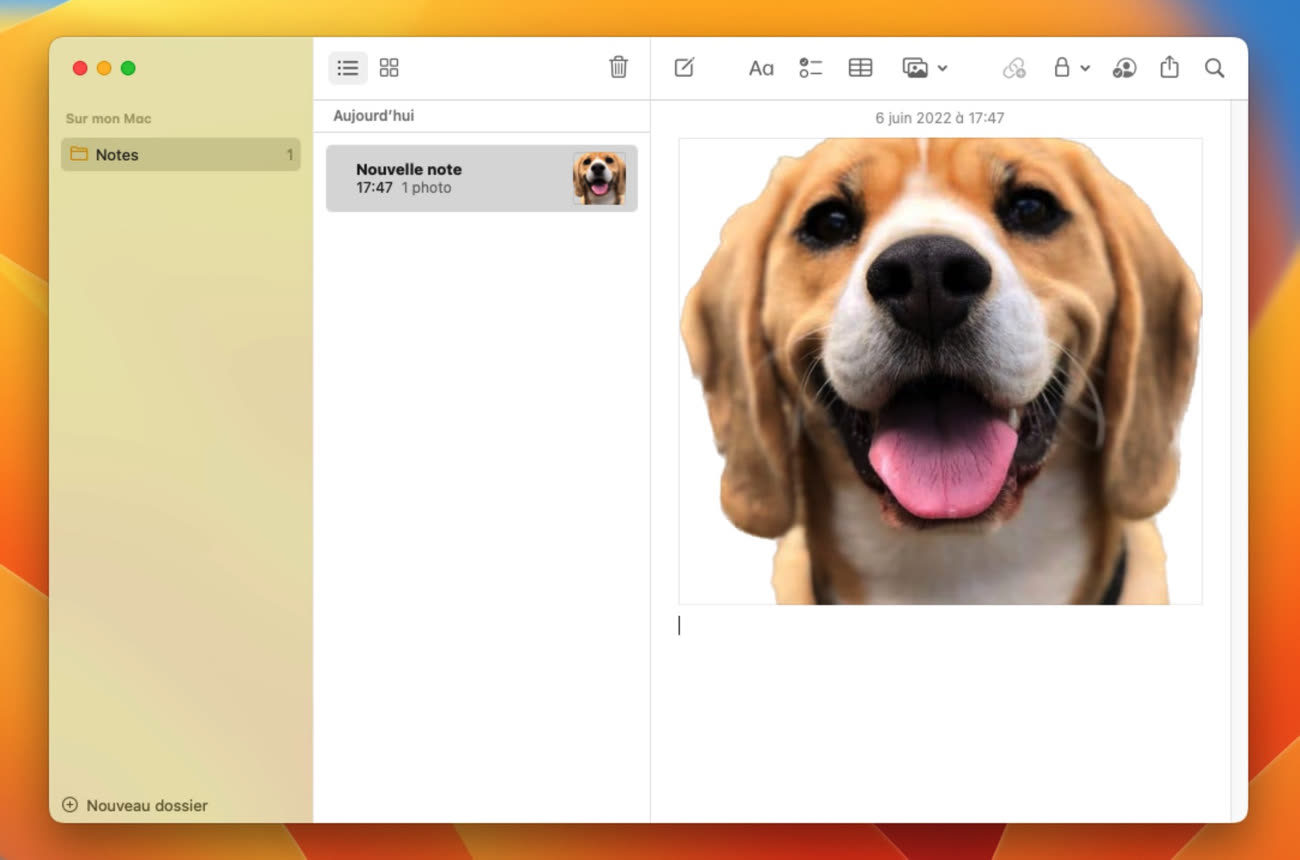

Vous pouvez l’utiliser sur vos animaux préférés, évidemment, sur des personnes, mais aussi des objets variés. J’ai testé avec des voitures, des trains, des monuments et même un (excellent) crumble, cela fonctionne remarquablement bien ! Voici quelques exemples, avec à chaque fois la photo originale et ce qui a été extrait par le système.

Le détourage n’est jamais parfait, surtout si vous agrandissez l’image extraite automatiquement, mais cela fait illusion et convient bien pour une conversation dans l’app Messages ou un photomontage rapide. L’image extraite est un PNG sur fond transparent et Apple réduit automatiquement sa taille par rapport au fichier original, peut-être pour éviter que les défauts de détourage ne soient trop visibles.

Sur iOS 16 comme sur iPadOS 16, tout se fait par un glisser-déposer après un tap prolongé, avec une petite gymnastique à apprendre pour distinguer la photo complète de l’objet que l’on veut extraire. Il y a manifestement encore quelques bugs dans la première bêta, ce qui est bien normal, et Apple a le temps d’améliorer tout ça.

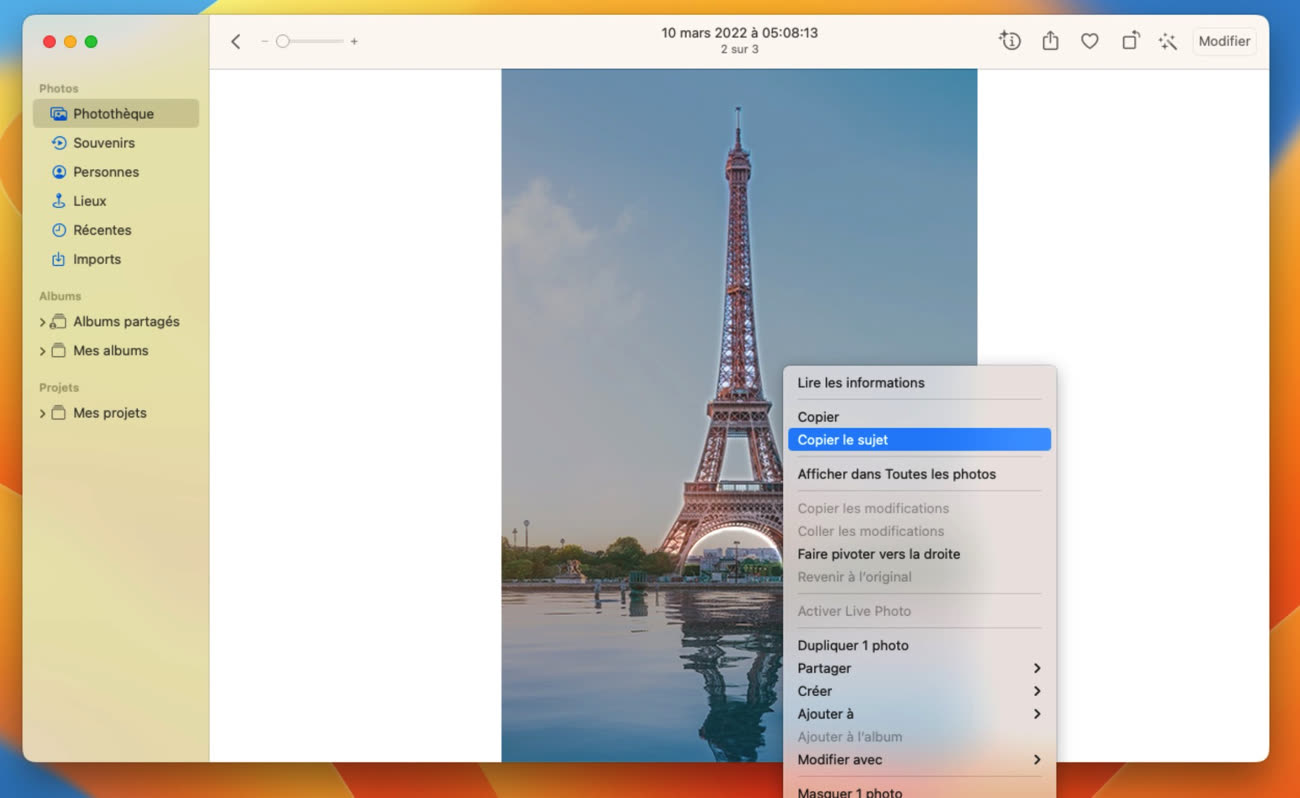

Sous macOS 13, la méthode est différente : il faut effectuer un clic secondaire sur une image et si l’app a détecté un élément à détourer, vous y verrez une ligne « Copier le sujet ». Le PNG détouré sera alors ajouté au presse-papiers et vous pouvez le coller n’importe où, dans Messages, Notes, ou autre.

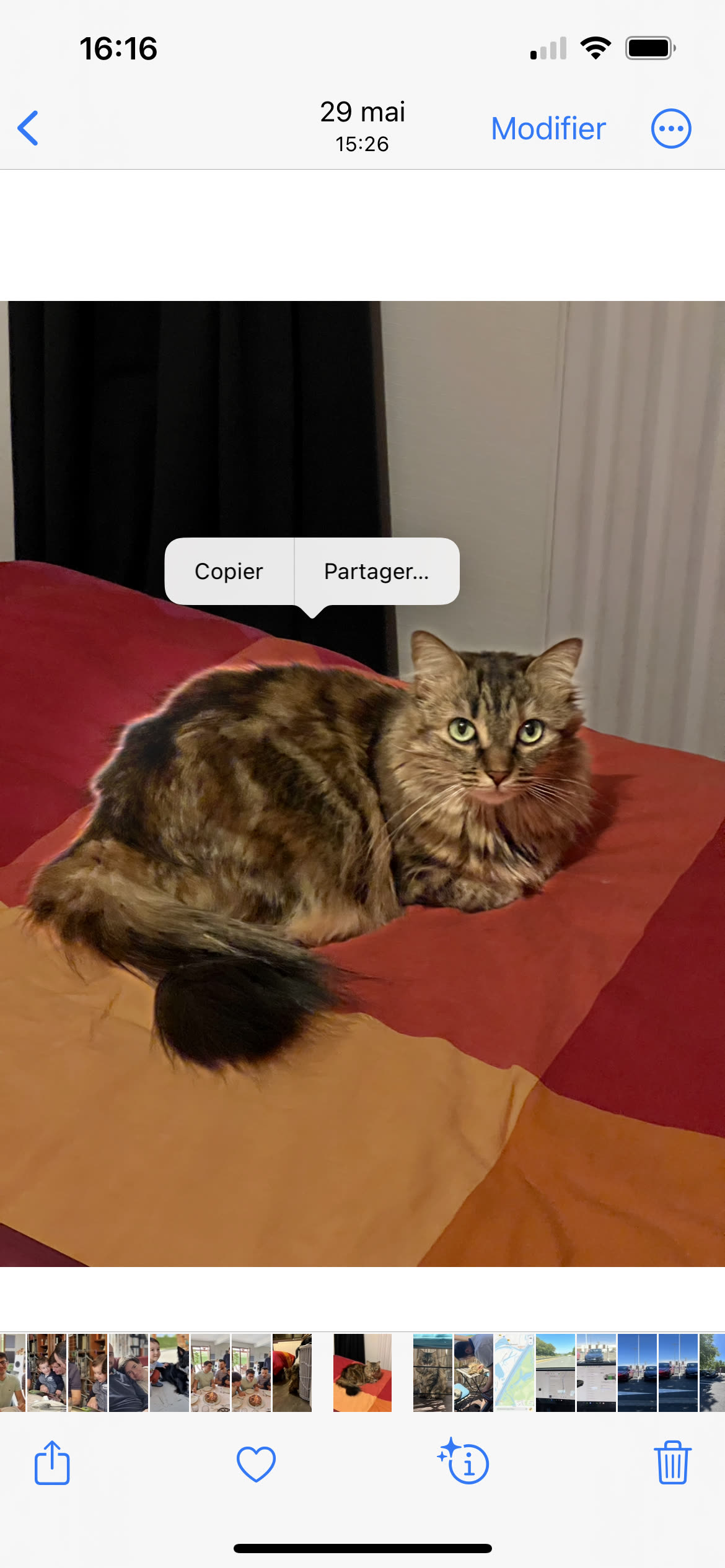

Mise à jour le 07/06/2022 16:17 : le glisser-déposer n’est pas la seule option pour extraire un sujet sur iOS. Il est aussi possible de toucher le sujet, de patienter une seconde ou deux et le système affiche alors un pop-up qui permet de copier l’image extraite ou de la partager directement. En outre, un trait animé montre ce qui sera extrait, ce qui est assez utile pour savoir si la fonction a vu juste sur la sélection ou pas.

Autre point important que j’avais oublié de préciser ce matin, il faut un appareil iOS équipé d’une puce Apple A12 au minimum pour bénéficier de cette nouvelle fonction.