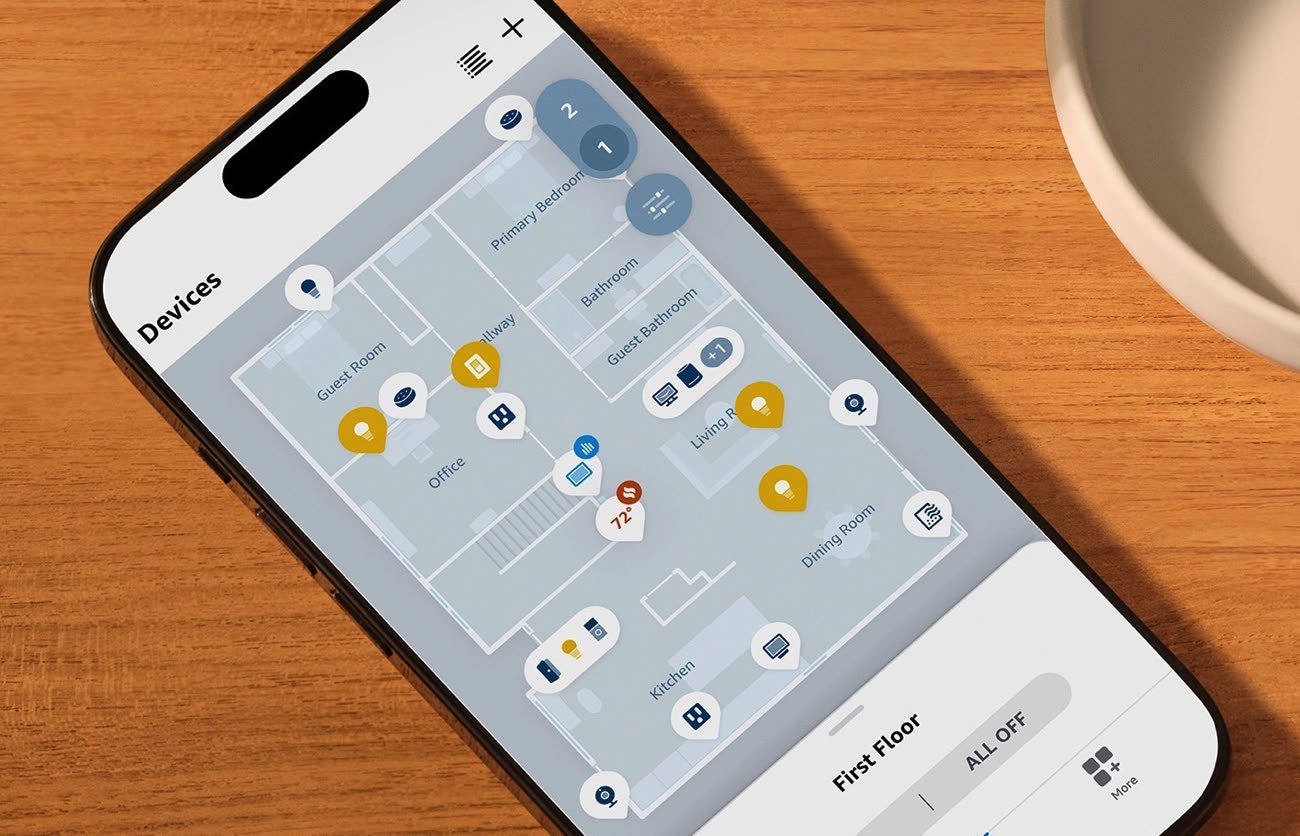

Samsung lance en France sa fonction "Vue Carte 3D", une représentation en volume de son domicile pour contrôler son équipement domotique. Une idée qu'Amazon teste aussi de son côté.

Plutôt qu'une liste ou un damier de boutons correspondant à tous les accessoires domotiques que l'on a chez soi, pourquoi ne pas avoir une vue 3D de son foyer ? C'est ce que Samsung appelle la Vue Carte 3D, une sorte de représentation de sa maison, comme dans Les Sims, avec tous les équipements représentés à leur place.

Dévoilée lors du dernier CES, la fonction est maintenant proposée en France au travers de l'application SmartThings sur Android et iOS. Le principe est d'établir une carte 3D de chacun des niveaux de sa maison et d'y positionner précisément des boutons correspondants aux différents accessoires connectés. Des objets 3D génériques représentant du mobilier sont proposés pour essayer de reproduire l'agencement de la pièce, afin de bien les distinguer les unes des autres.

Pour construire ce plan en volume, l'app a un éditeur avec des outils simples et ce catalogue de mobilier, mais on peut utiliser le LiDAR de son téléphone pour scanner sa pièce ou récupérer les données déjà collectées par son aspirateur robot comme en a Samsung avec le Bespoke Jet Bot.

Le fabricant sud-coréen n'est pas le seul à avoir imaginé cette représentation de son environnement domotique. À la fin de l'année dernière, Amazon a présenté à peu près la même chose avec Map View dans son app Alexa. Cette visualisation en 2D, qui est encore en test auprès d'un public restreint, montre aussi tous les accessoires au sein d'un plan de son domicile.

Ce système d'Amazon n'est proposé pour le moment que sur iPhone et iPad, uniquement les générations dotées d'un LiDAR. Peut-être y a-t-il une idée à creuser pour Apple afin d'étendre le champ d'utilisation de ce LiDAR (lire aussi Réalité augmentée : IKEA efface vos meubles pour en essayer de nouveaux).

Source :