Amazon a donné des explications sur les étapes qui ont conduit l'une de ses enceintes Echo à enregistrer une conversation au sein d'une famille puis à l'expédier à l'une de leurs connaissances. Cela s'est produit aux États-Unis il y a une quinzaine de jours.

Dans une déclaration à Recode, Amazon détaille :

Echo s'est réveillée en raison d'un mot, dans une conversation de fond, qui ressemblait à "Alexa". La conversation qui a suivi a été comprise comme une demande "d'envoi de message". À ce moment-là, Alexa a dit à haute voix « À qui ? »

À partir de là, les propos en arrière-plan ont été interprétés comme un nom dans la liste de contacts des clients. Alexa a alors demandé à haute voix, "[nom du contact], n'est-ce pas ?" Alexa a ensuite interprété la conversation de fond comme "exact". Aussi improbable que soit cette série d'événements, nous évaluons des options pour rendre cette éventualité encore moins probable.

La personne dans le carnet d'adresses, un employé du mari de la famille, avait reçu un fichier audio avec la portion enregistrée de cette conversation. « Vous étiez en train de parler de plancher en bois massif » a-t-il raconté à son patron pour lui montrer qu'il ne plaisantait pas.

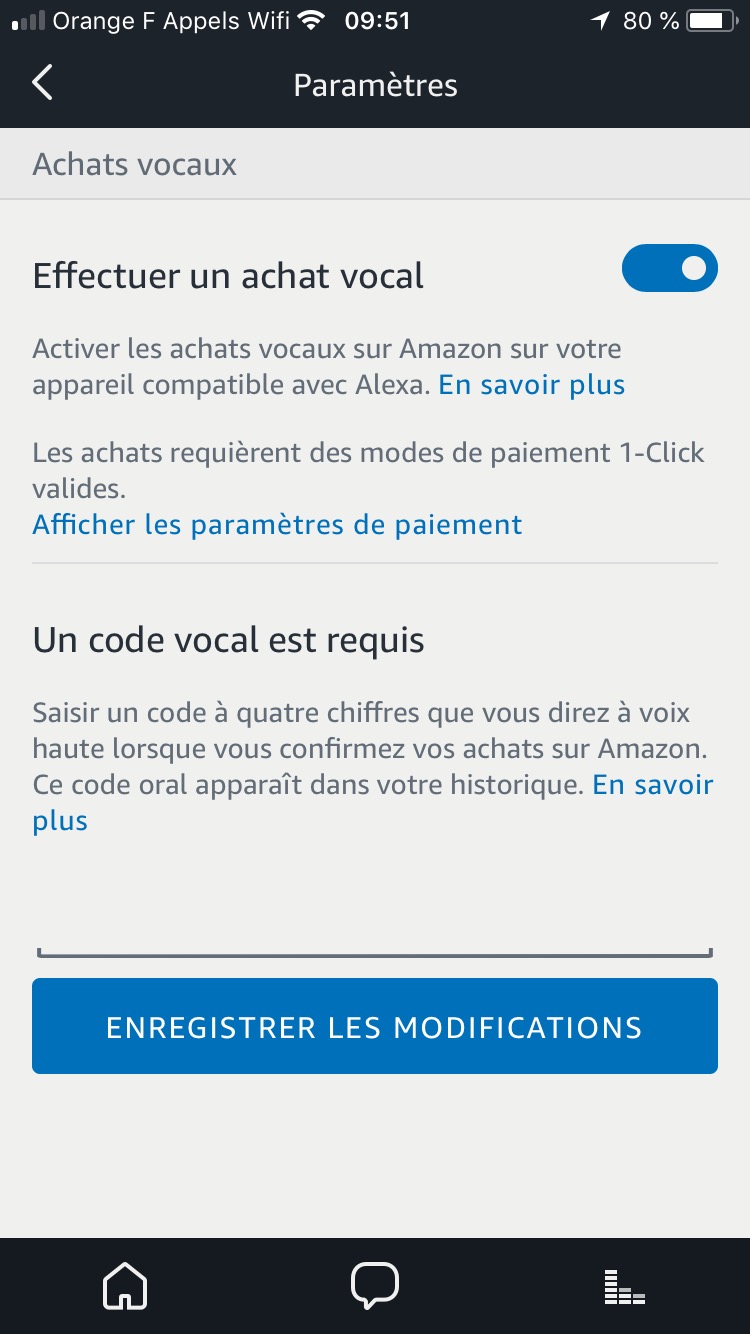

Les réglages d'Alexa permettent de bloquer certaines fonctions qui pourraient être utilisées de manière intempestive. On peut empêcher la commande d'articles sur Amazon qui, autrement, peuvent se faire en un clin d'œil dès lors qu'on a activé les achats 1-Click sur le site (on peut aussi définir un code oral de confirmation comme sécurité).

La version américaine d'Alexa propose aussi l'envoi de messages dictés, comme ce qui s'est passé ici. C'est également une option à activer mais pour la supprimer ensuite il n'y a pas d'autre moyen à ce jour que… de téléphoner au support technique d'Amazon. Mais à tout désactiver de peur que l'enceinte ne fasse du zèle, l'intérêt de celle-ci va forcément s'éroder.

Amazon doit lancer cette année en France ses enceintes Echo avec Alexa (toutes les pages d'aide sont traduites). Des employés et clients d'Amazon testent le produit dans l'Hexagone depuis la fin de l'année dernière. Sonos fait de même depuis quelques semaines avec un bêta-test de la version française d'Alexa sur ses Sonos One.

Mi-avril Le Figaro s'avançait sur une commercialisation des Echo pour le 23 mai, événement qui ne s'est finalement pas produit.