Le moins qu'on puisse dire, c'est qu'Apple a complètement loupé la communication autour de ses mesures pour la protection des enfants. Des chercheurs en sécurité aux employés, de la concurrence aux observateurs avisés, beaucoup de monde s'accorde à dire que le constructeur s'est tiré une balle dans le pied. Certes, la Pomme a promis de s'expliquer, mais jusqu'à présent ces efforts n'ont pas vraiment réussi à balayer les doutes.

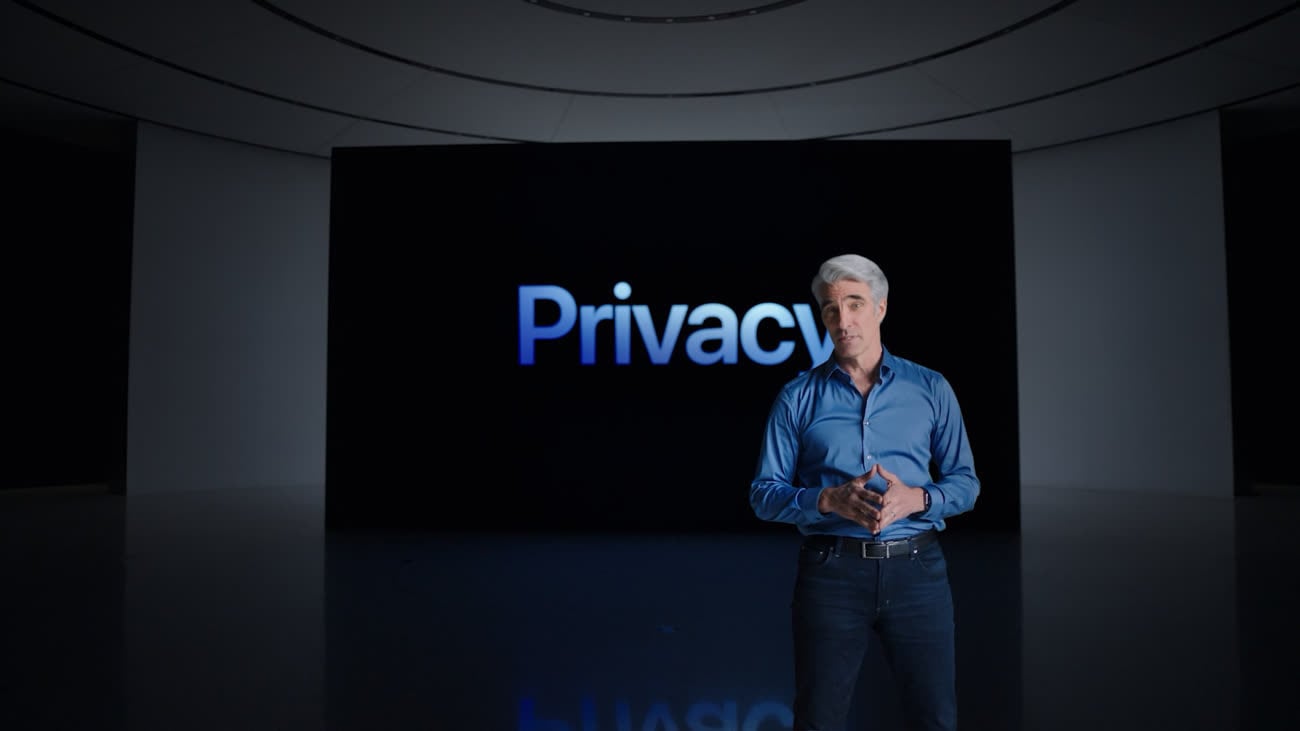

Bref, il fallait monter d'un cran et c'est nul autre que Craig Federighi qui monte au créneau dans une nouvelle interview au Wall Street Journal. « Au niveau de la compréhension des choses, c'est clair que beaucoup de messages se sont assez mal mélangés », admet le vice-président à l'ingénierie logicielle. « Nous souhaitons que ce soit un peu plus clair pour tout le monde, parce que nous pensons que ce que nous faisons est très positif ».

En annonçant plusieurs mesures n'ayant techniquement rien à voir entre elles, à savoir le floutage d'images sexuellement explicites dans Messages lorsque l'utilisateur est un enfant, et le scan de la bibliothèque de photos iCloud pour les images pédopornographiques, Apple a entretenu la confusion. Les photos innocentes des bambins en train de prendre leur bain allaient-elles être signalées à Apple comme étant pédopornographiques ?

« Avec le recul, l'annonce de ces deux fonctions en même temps allait effectivement créer de la confusion », convient Federighi. « Les gens ont connecté [ces deux fonctions] entre elles et ont eu très peur : que se passe-t-il avec mes messages ? La réponse est… rien. Rien ne se passe avec vos messages ».

Mais passé ce mea-culpa, pas question de revenir sur les mesures. Craig Federighi assure encore une fois que l'analyse de détection des photos pédopornographiques dites CSAM (Child Sexual Abuse Material) ne pourra pas être exploitée par des gouvernements autoritaires pour débusquer des opposants politiques. Apple dément cette possibilité car le système a été développé de telle sorte qu'un usage hors CSAM est impossible dans la pratique.

Apple l'assure, les gouvernements ne pourront pas abuser du nouveau mécanisme de lutte contre la pédopornographie

« Nous, qui nous considérons comme des leaders de la confidentialité, nous pensons que ce que nous faisons ici est à la pointe du progrès », ajoute-t-il. Le mécanisme repose sur une correspondance entre une base de données d'identifiants numériques d'images pédopornographiques et les photos de l'utilisateur.

Plus précisément, il s'agit de comparer des suites de chiffres : les images présentes dans l'iPhone sont converties par l'appareil en des numéros hachées par un processus cryptographique (baptisé NeuralHash). Ce processus de comparaison est réalisé sur l'appareil en local, avant que les images soient téléversées dans la bibliothèque iCloud Photos de l'utilisateur.

En cas de correspondance avec la base de données, la photo uploadée s'accompagne d'un « bon de sécurité » ainsi que d'un « dérivé visuel ». À partir d'un certain nombre de correspondances, Apple peut déchiffrer le contenu du bon de sécurité, une opération qui est ensuite visée par un opérateur humain. Craig Federighi révèle que ce nombre de correspondances a été fixé à « quelque chose comme » 30 images pédopornographiques connues.

Ce n'est que lorsque ce seuil est atteint qu'Apple sait « quelque chose de votre compte et même à ce stade, on ne connait que ces images, pas les autres images ». Il poursuit : « Ça n'a rien à voir avec les images de votre enfant dans son bain. Ni même avec des images pornographiques qui seraient en votre possession. Ce système se contente d'examiner les correspondances entre les signatures numériques de vos photos avec des images pédopornographiques connues ».

Pourquoi ne pas s'être contenté de scanner les photos uniquement sur les serveurs, comme le reste de la concurrence depuis des années et comme Apple le faisait déjà elle-même ? Le processus réalisé sur l'iPhone permet aux chercheurs en sécurité de regarder ce qui se passe dans iOS, explique-t-il en substance. « Donc, si des changements étaient apportés pour étendre la portée [du système de détection] d'une manière que nous nous étions engagés à ne pas faire, il y a un moyen de le vérifier, ils peuvent repérer ce qui se passe ».

Apple jusque-là en retard dans la lutte contre la pédopornographie

Sur ce plan, Federighi en dit trop ou pas assez. En dehors de l'iPhone SRD fourni à des chercheurs en sécurité triés sur le volet, il n'existe aucun moyen officiel de lever le capot d'iOS pour en vérifier le code. Peut-être qu'Apple a en projet d'ouvrir un peu sa boîte noire afin que des spécialistes puissent vérifier la réalité de son fonctionnement ? Il existe aussi des manières officieuses de jeter un œil dans le code, comme les rumeurs s'en sont fait une spécialité.

Le vice-président ajoute que la base de données des photos pédopornographiques ne provient pas uniquement du National Center for Missing and Exploited Children (NCMEC) il y a au moins deux organismes dans des « juridictions distinctes » et qu'un auditeur indépendant sera en mesure de vérifier si cette base de données ne contient que des images fournies par ces groupes. Une manière de s'assurer que le fichier ne contient pas d'autres photos n'ayant rien à voir avec le sujet.