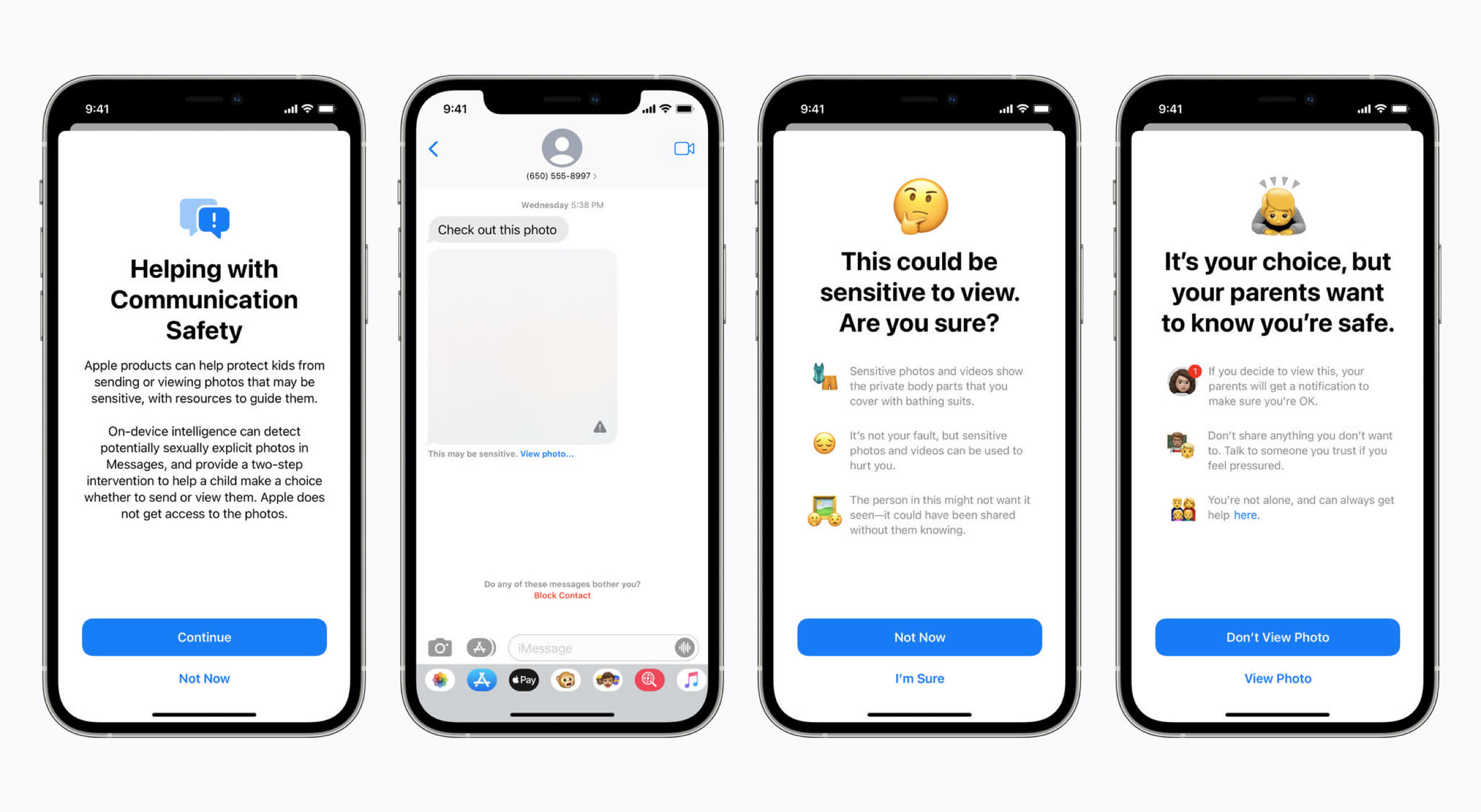

Apple pourrait introduire dans iOS 15.2 un des mécanismes de protection de l'enfance annoncés cet été : le code de la première bêta contient des références à Communication Safety, qui floute les images licencieuses partagées dans Messages et prévient les enfants et les parents que des photos sexuellement sans équivoque ont été envoyées ou reçues.

C'est une fonction destinée aux utilisateurs d'iPhone, d'iPad ou de Mac de moins de 17 ans inscrits dans le partage familial d'iOS. Le traitement est réalisé en local, sur l'appareil donc. Les images sont certes transférées sur les serveurs d'Apple, mais comme pour le reste des conversations, elles sont chiffrées de bout en bout et le constructeur ne peut pas les lire. C'est donc l'appareil qui analyse les images, détermine si elles sont à connotation sexuelle, et les masque au besoin.

Par ailleurs, l'envoi de notifications aux parents est automatique lorsque l'enfant est âgé de 12 ans et moins. Pour les enfants de 13 à 17 ans, il n'y aura pas de notification. Selon les découvertes de Steve Moser relayées par MacRumors, iOS 15.2 contient des messages d'alerte en lien avec cette fonction : « Préviens un adulte en qui tu as confiance », « Ce n'est pas ta faute mais les photos explicites peuvent faire du mal », « Partager des photos de nus de personnes de moins de 18 ans peut avoir des conséquences légales »…

Ce système de floutage et de notification a fait polémique cet été lors de son annonce, mais moins que l'autre mesure qu'Apple voulait mettre en place en parallèle : un mécanisme de vérification des photos à caractère pédopornographique (CSAM pour Child Sexual Abuse Material) sur les terminaux, accompagné d'un traitement supplémentaire sur les serveurs d'Apple le cas échéant. Cette dernière mesure a provoqué un tel tollé que le constructeur en a repoussé la mise en œuvre.

L'été où l'iPhone est devenu une passoire de sécurité qui vous flique

On verra comment évolueront les travaux pour cette fonction de Messages, qui ne devrait être lancée qu'aux États-Unis. Et peut-être que cela donnera l'occasion à Apple de communiquer sur la détection CSAM qui elle, est toujours dans les limbes.

Mise à jour — Apple a prévenu que Communication Safety ne sera pas implémenté dans iOS 15.2, du moins pas de cette manière.